Informatikk

Datavitenskap er vitenskapen om systematisk representasjon, lagring, behandling og overføring av informasjon , med særlig fokus på automatisk behandling med digitale datamaskiner . [1] Det er en grunnleggende og formell vitenskap samt en ingeniørfag . [2]

Datavitenskapens historie

opprinnelse

Gottfried Wilhelm Leibniz hadde allerede håndtert binære tallrepresentasjoner . Sammen med boolsk algebra , som først ble utarbeidet av George Boole i 1847, danner de de viktigste matematiske grunnlagene for senere datasystemer. I 1937 publiserte Alan Turing sitt arbeid On Computable Numbers with an Application to the Decision Problem , der Turing -maskinen oppkalt etter ham ble presentert, en matematisk maskinmodell som er av stor betydning for teoretisk informatikk den dag i dag. Den dag i dag er begrepet forutsigbarhet basert på universelle modeller som Turing -maskinen og kompleksitetsteorien , som begynte å utvikle seg på 1960 -tallet. Til i dag har forutsigbarhet vært basert på varianter av disse modellene.

etymologi

Ordet informatikk ble opprettet ved å legge til suffikset -ik til roten til informasjon . Begrepet informatikk ble laget av Karl Steinbuch og kan spores tilbake til hans første publikasjon "Computer Science: Automatic Information Processing" fra 1957, som han publiserte i Standard Elektrik AG (SEG). [3] [4] For å understreke viktigheten av automatisering eller matematikk for informatikk, blir informatikk noen ganger gitt ut som et koffertord bestående av informasjon og automatisering eller informasjon og matematikk . [5]

Etter et internasjonalt kollokvium i Dresden 26. februar 1968 etablerte informatikk seg som et navn for vitenskap basert på fransk (informatique) og russiske modeller (Информатика) i det tysktalende området. [6] [7] I juli samme år ble begrepet datavitenskap brukt for første gang som det tyske navnet på et nytt emne i en Berlin -tale av minister Gerhard Stoltenberg . [8] Mens begrepet informatikk er vanlig i den engelskspråklige verden, den tyske tilsvarer informatikk kunne etablere seg. Imidlertid brukes begrepet informatikk på engelsk for visse deler av anvendt informatikk - for eksempel når det gjelder bioinformatikk eller geoinformatikk . Når det gjelder oversettelser til engelsk, er begrepet informatikk noen ganger foretrukket fremfor datavitenskap i tysktalende land. [9]

Utvikling av informatikk til vitenskap

I Tyskland går begynnelsen på datavitenskap tilbake til Institute for Practical Mathematics (IPM) ved Technical University of Darmstadt (TH Darmstadt) , som matematikeren Alwin Walther bygde opp siden 1928. [10] I 1956 klarte de første studentene ved Darmstadt elektroniske kalkulator å håndtere problemene med kalkulatorer. Samtidig ble de første programmeringsforedragene og praksisplassene tilbudt på TH Darmstadt. På grunn av omdømmet som TH Darmstadt den gang hadde innen dataforskning, fant den første kongressen i det tysktalende området om informatikk ( elektroniske beregningsmaskiner og informasjonsbehandling ) med internasjonal deltakelse i oktober 1955 på TH Darmstadt.

På 1960 -tallet manglet Tyskland konkurranseevne innen databehandling (DV). For å motvirke dette vedtok Forbundsutvalget for vitenskapelig forskning programmet for fremme av forskning og utvikling innen databehandling for offentlige oppgaver 26. april 1967. Det såkalte "Technical Advisory Board for Data Processing" var ansvarlig for implementeringen og besto hovedsakelig av representanter fra universiteter og ikke-universitets forskningsinstitusjoner. På det syvende møtet i det rådgivende styret 15. november 1967 signaliserte Karl Ganzhorn , som var ansvarlig for forskning og utvikling på IBM Tyskland på den tiden, industriens problemer med å finne kvalifisert personell. Direktøren for Institute for Message Processing ved TH Darmstadt, Robert Piloty , påpekte at de tyske universitetene er ansvarlige for opplæring av kvalifisert personale. Som et resultat ble komiteen "IT -stoler og opplæring" dannet. Piloty tok stolen. Komiteen formulerte anbefalinger for opplæring av informatikere, som sørget for etablering av et kurs i informatikk ved flere universiteter og tekniske høyskoler. [10]

I 1967 tilbød det tekniske universitetet i München et kurs i informasjonsbehandling som en del av matematikkurset på initiativ av Friedrich Ludwig Bauer . [10] [11] [12] I 1968 introduserte TH Darmstadt det første informatikk -kurset. I 1969 fulgte kurset "datateknologi (teknisk informatikk)" og i 1970 et matematikkurs, som avsluttet med graden "ingeniør i matematikk med fokus på informatikk". [10] 1. september 1969 startet det tekniske universitetet i Dresden det første universitetet i DDR med opplæring av Dipl.-Ing. for informasjonsbehandling. Også i 1969 begynte Furtwangen ingeniørskole (senere Furtwangen University of Applied Sciences ) å trene, fremdeles kalt informasjonsteknologi her. [13] I vintersemesteret 1969/70 var University of Karlsruhe (nå Karlsruhe Institute of Technology ) det første tyske universitetet som tilbød en grad i informatikk som førte til en grad i informatikk. [14]

Johannes Kepler University (JKU) Linz startet i vintersemesteret 1969/70 som det første østerrikske universitetet som spesialiserte seg i informatikk og utdannet seg til ingeniør. [15] Det tekniske universitetet i Wien fulgte i vintersemesteret 1970/71. [16] Noen år senere grunnla de første fakultetene for informatikk, og hadde allerede siden 1962 ved Purdue University bestått en institutt for informatikk.

I engelsktalende land omtales den enkelte vitenskap som informatikk . Den første universitetsgraden var Diploma in Numerical Analysis and Automatic Computing fra University of Cambridge . Det ettårige videreutdanningen kan begynne i oktober 1953. [17] [18]

Organisasjoner

Gesellschaft für Informatik (GI) ble grunnlagt i 1969 og er det største spesialbyrået i tysktalende land. De to store amerikanske foreningene, Association for Computing Machinery (ACM) siden 1947 og Institute of Electrical and Electronics Engineers (IEEE) siden 1963, er av særlig internasjonal betydning. Forumet for informatikere for fred og samfunnsansvar . Association for Computing Machinery tildeler årlig Turing -prisen , som omtrent kan sammenlignes med Nobelprisen når det gjelder rangering innen informatikk.

Regnemaskiner - forløpere til datamaskinen

Arbeidet med å utvikle to typer maskiner kan sees på som de første forløperne til informatikk utover matematikk: de ved hjelp av hvilke matematiske beregninger kan utføres eller forenkles (" beregningsmaskiner ") og de som kan trekkes logiske konklusjoner med og argumenter som er kontrollert kan være (" logiske maskiner "). Som enkle beregningsinnretninger ga abacus og senere lysbilderegelen uvurderlige tjenester. I 1641 konstruerte Blaise Pascal en mekanisk beregningsmaskin som kunne utføre addisjoner og subtraksjoner, inkludert overføringer . Bare litt senere presenterte Gottfried Wilhelm Leibniz en beregningsmaskin som kunne utføre alle fire grunnleggende regnearbeidene. Disse maskinene er basert på sammenblandende tannhjul. Et skritt mot større fleksibilitet ble tatt fra 1838 og fremover av Charles Babbage , som hadde som mål å kontrollere de aritmetiske operasjonene ved hjelp av slagkort . Bare Herman Hollerith kunne lønnsomt implementere denne ideen takket være teknisk fremgang fra 1886 og fremover. Telemaskinene hans basert på hullkort ble blant annet brukt til å evaluere en folketelling i USA.

Historikken til logiske maskiner spores ofte tilbake til 1200 -tallet og spores tilbake til Ramon Llull . Selv om hans kalkulerende disklignende konstruksjoner, der flere disker som roterte mot hverandre kunne representere forskjellige kombinasjoner av begreper, ikke var mekanisk veldig komplekse, var det sannsynligvis han som gjorde ideen om en logisk maskin kjent. Bortsett fra denne veldig tidlige forløperen, er historien til logiske maskiner enda mer forsinket enn beregningsmaskinene: en lysbilde-regellignende enhet av den tredje jarlen Stanhope , som er kreditert for å ha kontrollert gyldigheten av syllogismer (i aristotelisk forstand), går tilbake til 1777. En ekte "maskin" har blitt overlevert for første gang i form av "Logical Piano" av Jevons på slutten av 1800 -tallet. Bare litt senere ble mekanikken erstattet av elektromekaniske og elektriske kretser. De logiske maskinene nådde sitt høydepunkt på 1940- og 1950 -tallet, for eksempel med maskinene fra den engelske produsenten Ferranti . Med utviklingen av universelle digitale datamaskiner - i motsetning til beregningsmaskiner - tok historien til uavhengige logiske maskiner en brå slutt, ettersom oppgavene de behandlet og løste ble stadig mer implementert i programvare på nettopp de datamaskinene hvis maskinvareforgjengere de tilhører.

Utvikling av moderne beregningsmaskiner

En av de første større beregningsmaskinene er Z1 fra 1937, som ble opprettet av Konrad Zuse og fremdeles fungerer rent mekanisk. På den tiden var tabuleringsmaskiner den dominerende teknologien i store administrasjoner, med Zuse som forutså bruk i ingeniørsektoren. Fire år senere implementerte Zuse ideen sin ved hjelp av elektriske reléer : Z3 fra 1941 var verdens første fullt funksjonelle, fritt programmerbare digitale datamaskin [19] for å skille kommando- og dataminner fra inngangs- / utgangsbordet.

Litt senere ble arbeidet med å bygge beregningsmaskiner for å knekke hemmelige tyske meldinger presset videre med stor suksess under ledelse av Alan Turing ( Turingbombe ) og Thomas Flowers (Colossus). Samtidig utviklet Howard Aiken Mark I (1944), den første programstyrte relédatamaskinen i USA, hvor videreutviklingen ble betydelig avansert. Ytterligere relé -datamaskiner ble bygget i Bell -laboratoriene (George Stibitz). Atanasoff-Berry-datamaskinen regnes som den første rørdatamaskinen. En av hovedaktørene her er John von Neumann , som Von Neumann -arkitekturen , som fortsatt er viktig i dag, er oppkalt etter. I 1946 ble rørdatamaskinen ENIAC utviklet , i 1949 ble EDSAC bygget - med den første implementeringen av Von Neumann -arkitekturen.

Fra 1948 og utover begynte IBM å utvikle datamaskiner og ble markedsleder innen ti år. En milepæl i selskapets historie var introduksjonen av System / 360 i 1964. Hovedrammen er stamfaren til dagens Z-Systems mainframes og fulgte IBM 700/7000-serien . Allerede i 1959 ble IBM 1401, en datamaskin for mellomstore selskaper, introdusert, som ofte blir referert til som Ford Model T i datamaskinindustrien på grunn av salgstallene. Med utviklingen av transistorteknologi og mikroprosessorteknologi ble datamaskiner mer og mer kraftige og billigere. I 1982 åpnet Commodore -selskapet endelig massemarkedet med C64, spesielt for hjemmebrukere, men også langt utover.

Programmerings språk

Oppfinnelsen av "automatisk programmering" av Heinz Rutishauser (1951) var viktig for utviklingen av programmeringsspråk. I 1956 beskrev Noam Chomsky et hierarki av formelle grammatikker som formelle språk og spesielle maskinmodeller samsvarer med. Disse formaliseringene ble svært viktige for utviklingen av programmeringsspråk . Viktige milepæler var utviklingen av Fortran (fra engelsk: "FORmula TRANslation", formeloversettelse; første programmeringsspråk på høyt nivå , 1957), ALGOL (fra engelsk: "ALGOrithmic Language", algoritmespråk; strukturert / imperativt ; 1958/1960/ 1968), Lisp (fra engelsk: "LISt Processing", behandling av lister; funksjonell , 1959), COBOL (fra engelsk: "COmmon Business Orientated Language", programmeringsspråk for kommersielle applikasjoner, 1959), Smalltalk ( objektorientert , 1971 ), Prolog ( logisk , 1972) og SQL ( relasjonsdatabaser , 1976). Noen av disse språkene står for typiske programmeringsparadigmer for sin respektive tid. Andre programmeringsspråk som har vært i bruk lenge er BASIC (siden 1960), C (siden 1970), Pascal (siden 1971), Objective-C ( objektorientert , 1984), C ++ (objekt- orientert, generisk , multi-paradigme, siden 1985), Java (objektorientert, siden 1995) og C # (objektorientert, rundt 2000). Språk og paradigmeskift ble intensivt ledsaget eller fremmet av datavitenskapelig forskning.

Som med andre vitenskaper er det også en økende trend mot spesialisering.

Informatikkfag

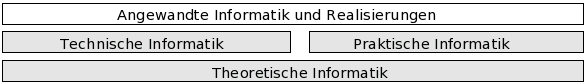

Informatikk er delt inn i delområdene teoretisk informatikk , praktisk informatikk og teknisk informatikk .

Datavitenskapens anvendelser på de ulike områdene i dagliglivet så vel som i andre spesialiseringsområder, for eksempel forretningsinformatikk , geoinformatikk og medisinsk informatikk, omtales som anvendt informatikk . Virkningene på samfunnet blir også undersøkt på tverrfaglig måte.

Teoretisk informatikk danner det teoretiske grunnlaget for de andre delområdene. Den gir grunnleggende kunnskap om problemers avgjørbarhet , for klassifisering av kompleksiteten og for modellering av automat og formelle språk .

Fagene praktisk og teknisk informatikk er basert på disse funnene. Du håndterer sentrale problemer med informasjonsbehandling og ser etter gjeldende løsninger.

Resultatene blir til slutt brukt i anvendt informatikk. Maskinvare- og programvareimplementeringer kan tilordnes dette området og dermed en stor del av det kommersielle IT -markedet. De tverrfaglige emnene undersøker også hvordan informasjonsteknologi kan løse problemer på andre vitenskapsområder, for eksempel utvikling av romlige databaser for geografi , men også forretnings- eller bioinformatikk .

Teoretisk informatikk

Som ryggraden i informatikk, omhandler feltet teoretisk informatikk de abstrakte og matematikkorienterte aspektene ved vitenskap. Området er bredt og omhandler emner fra teoretisk lingvistikk ( teori om formelle språk eller automatteori ), beregningsbarhet og kompleksitetsteori . Målet med disse delområdene er å gi omfattende svar på grunnleggende spørsmål som "Hva kan beregnes?" Og "Hvor effektivt / effektivt kan du beregne noe?".

Automatateori og formelle språk

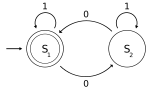

I informatikk er automater "imaginære maskiner" som oppfører seg i henhold til visse regler. En endelig automat har et begrenset sett med interne tilstander. Den leser i et "inputord" tegn for tegn og utfører en tilstandsovergang for hvert tegn. I tillegg kan den sende ut et "utgangssymbol" for hver tilstandsovergang. Når inngangen er fullført, kan maskinen godta eller avvise inndataordet.

Den formelle språketilnærmingen har sitt utspring i lingvistikk og er derfor godt egnet til å beskrive programmeringsspråk. Imidlertid kan formelle språk også beskrives av maskinmodeller, siden settet med alle ordene som godtas av en maskin kan sees på som et formelt språk.

Mer komplekse modeller har et minne, for eksempel push-down- maskiner eller Turing-maskinen, som ifølge Church-Turing-avhandlingen kan reprodusere alle funksjoner som kan beregnes av mennesker.

Beregningsteori

I sammenheng med beregningsteori undersøker teoretisk informatikk hvilke problemer som kan løses med hvilke maskiner. En datamodell eller et programmeringsspråk kalles Turing-complete hvis den kan brukes til å simulere en universell Turing-maskin . Alle datamaskiner som brukes i dag og de fleste programmeringsspråk er Turing-complete, noe som betyr at du kan bruke dem til å løse de samme oppgavene. Alternative beregningsmodeller som lambda calculus , WHILE-programmer , μ-rekursive funksjoner eller registermaskiner viste seg også å være Turing-komplette. Church-Turing-oppgaven utviklet seg fra disse funnene, som, selv om den formelt ikke kan bevises, er generelt akseptert.

Begrepet avgjørbarhet kan illustreres som spørsmålet om et bestemt problem kan løses algoritmisk. Et avgjørbart problem er for eksempel egenskapen til en tekst for å være et syntaktisk korrekt program. Et problem som ikke kan avgjøres, er for eksempel spørsmålet om et gitt program med gitte inndataparametere noen gang kommer til et resultat, som omtales som et stallproblem .

Kompleksitetsteori

Kompleksitetsteorien omhandler ressurskravene til algoritmisk behandlingsbare problemer på forskjellige matematisk definerte formelle datamodeller, samt kvaliteten på algoritmene som løser dem. Spesielt blir ressursene " kjøretid " og " lagringsplass " undersøkt, og kravene deres er vanligvis representert i Landau -notasjon . Først og fremst blir kjøretiden og kravet til lagringsplass notert avhengig av lengden på inngangen. Algoritmer som høyst varierer med en konstant faktor i deres kjøretid eller lagringskrav, er tilordnet samme klasse, dvs. et sett med problemer med en tilsvarende kjøretid som kreves av algoritmen for løsningen, ved bruk av Landau -notasjonen.

En algoritme, kjøretiden som er uavhengig av inngangslengden, fungerer "i konstant tid", skriver du . For eksempel vil programmet "returner det første elementet i en liste" fungere i konstant tid. Programmet "sjekk om et bestemt element er inneholdt i en usortert lengdeliste n" trenger "lineær tid", det vil si , for i verste fall må innspillingslisten leses nøyaktig en gang.

Kompleksitetsteorien har så langt bare gitt øvre grenser for ressurskravene til problemer, fordi metoder for eksakte nedre grenser nesten ikke er utviklet, og bare noen få problemer er kjent (for eksempel for oppgaven med å sortere en verdiliste med hjelp av et gitt ordensforhold gjennom sammenligninger, den nedre grensen ). Likevel finnes det metoder for å klassifisere spesielt vanskelige problemer som sådan, der teorien om NP-fullstendighet spiller en sentral rolle. I henhold til dette er et problem spesielt vanskelig hvis man ved å løse det også automatisk kan løse de fleste andre naturproblemene uten å bruke vesentlig flere ressurser.

Det største åpne spørsmålet innen kompleksitetsteori er spørsmålet om “ P = NP ?” . Problemet er et av Millennium -problemene som Clay Mathematics Institute annonserte for 1 million dollar. Hvis P ikke er lik NP, kan ikke NP-komplette problemer løses effektivt.

Teori om programmeringsspråk

Dette området omhandler teori, analyse, karakterisering og implementering av programmeringsspråk og forskes aktivt innen både praktisk og teoretisk informatikk. Delområdet påvirker sterkt relaterte fagområder som deler av matematikk og lingvistikk .

Formelle metoder teori

Teorien om formelle metoder omhandler en rekke teknikker for den formelle spesifikasjonen og verifiseringen av programvare og maskinvaresystemer . Motivasjonen for dette området kommer fra ingeniørtenkning - streng matematisk analyse bidrar til å forbedre påliteligheten og robustheten til et system. Disse egenskapene er spesielt viktige i systemer som arbeider i sikkerhetskritiske områder. Å forske på slike metoder krever blant annet kunnskap om matematisk logikk og formell semantikk .

Praktisk informatikk

Praktisk informatikk utvikler grunnleggende konsepter og metoder for å løse spesifikke problemer i den virkelige verden, for eksempel håndtering av data i datastrukturer eller utvikling av programvare . Utviklingen av algoritmer spiller en viktig rolle her. Eksempler på dette er sorterings- og søkealgoritmer .

Et av de sentrale temaene for praktisk informatikk er programvareteknologi (også kalt software engineering ). Hun tar for seg systematisk opprettelse av programvare. Konsepter og foreslåtte løsninger for store programvareprosjekter er også utviklet, noe som bør tillate en repeterbar prosess fra ideen til den ferdige programvaren.

| C kildekode | Maskinkode (skjematisk) | |

|---|---|---|

/ **

* Beregning av GCD av to tall

* i henhold til den euklidiske algoritmen

* /

int ggt ( int nummer1 , int nummer2 ) {

int temp ;

mens ( nummer2 ! = 0 ) {

temp = nummer1 % nummer2 ;

nummer1 = tall2 ;

nummer2 = temp ;

}

returnere tall1;

}

|

→ Kompilator → |

... 0010 0100 1011 0111 1000 1110 1100 1011 0101 1001 0010 0001 0111 0010 0011 1101 0001 0000 1001 0100 1000 1001 1011 1110 0001 0011 0101 1001 0111 0010 0011 1101 0001 0011 1001 1100 ... |

Et viktig tema i praktisk informatikk er kompilatorkonstruksjon , som også blir undersøkt i teoretisk informatikk. En kompilator er et program som oversetter andre programmer fra et kildespråk (f.eks. Java eller C ++ ) til et målspråk. En kompilator gjør det mulig for en person å utvikle programvare på et mer abstrakt språk enn maskinspråket som CPU -en bruker .

Et eksempel på bruk av datastrukturer er B-treet , som tillater raske søk i store databaser i databaser og filsystemer .

Teknisk informatikk

Teknisk informatikk omhandler det grunnleggende om maskinvare i informatikk, for eksempel mikroprosessorteknologi , datamaskinarkitektur , innebygde og sanntidssystemer , datanettverk inkludert tilhørende systemrelatert programvare, samt modellerings- og evalueringsmetoder utviklet for dette formålet.

Mikroprosessorteknologi, datamaskindesignprosess

Mikroprosessorteknologi domineres av den raske utviklingen av halvlederteknologi . Strukturbreddene i nanometerområdet muliggjør miniatyrisering av svært komplekse kretser med flere milliarder individuelle komponenter. Denne kompleksiteten kan bare mestres med sofistikerte designverktøy og kraftige maskinvarebeskrivelsesspråk . Veien fra ideen til det ferdige produktet går gjennom mange stadier, som i stor grad er datamaskinstøttet og sikrer en høy grad av nøyaktighet og feilfrihet. Hvis maskinvare og programvare er designet sammen på grunn av høye ytelseskrav, blir dette også referert til som hardware-software co-design.

Arkitekturer

Die Rechnerarchitektur bzw. Systemarchitektur ist das Fachgebiet, das Konzepte für den Bau von Computern bzw. Systemen erforscht. Bei der Rechnerarchitektur wird z. B. das Zusammenspiel von Prozessoren , Arbeitsspeicher sowie Steuereinheiten ( Controller ) und Peripherie definiert und verbessert. Das Forschungsgebiet orientiert sich dabei sowohl an den Anforderungen der Software als auch an den Möglichkeiten, die sich über die Weiterentwicklung von Integrierten Schaltkreisen ergeben. Ein Ansatz ist dabei rekonfigurierbare Hardware wie z. B. FPGAs (Field Programmable Gate Arrays), deren Schaltungsstruktur an die jeweiligen Anforderungen angepasst werden kann.

Aufbauend auf der Architektur der sequentiell arbeitenden Von-Neumann-Maschine , bestehen heutige Rechner in der Regel aus einem Prozessor, der selbst wieder mehrere Prozessorkerne, Speicher-Controller und eine ganze Hierarchie von Cache -Speichern enthalten kann, einem als Direktzugriffsspeicher ( Random-Access Memory , RAM) ausgelegten Arbeitsspeicher (Primärspeicher) und Ein/Ausgabe-Schnittstellen unter anderem zu Sekundärspeichern (z. B. Festplatte oder SSD-Speicher ). Durch die vielen Einsatzgebiete ist heute ein weites Spektrum von Prozessoren im Einsatz, das von einfachen Mikrocontrollern , z. B. in Haushaltsgeräten über besonders energieeffiziente Prozessoren in mobilen Geräten wie Smartphones oder Tabletcomputern bis hin zu intern parallel arbeitenden Hochleistungsprozessoren in Personal Computern und Servern reicht. Parallelrechner gewinnen an Bedeutung, bei denen Rechenoperationen auf mehreren Prozessoren gleichzeitig ausgeführt werden können. Der Fortschritt der Chiptechnik ermöglicht heute schon die Realisierung einer großen Zahl (gegenwärtige Größenordnung 100…1000) von Prozessorkernen auf einem einzigen Chip ( Mehrkernprozessoren , Multi/Manycore-Systeme, „ System-on-a-Chip “ (SoCs)).

Ist der Rechner in ein technisches System eingebunden und verrichtet dort weitgehend unsichtbar für den Benutzer Aufgaben wie Steuerung, Regelung oder Überwachung, spricht man von einem eingebetteten System. Eingebettete Systeme sind in einer Vielzahl von Geräten des Alltags wie Haushaltsgeräten, Fahrzeugen, Geräten der Unterhaltungselektronik, Mobiltelefonen, aber auch in industriellen Systemen z. B. in der Prozessautomation oder der Medizintechnik im Einsatz. Da eingebettete Computer immerzu und überall verfügbar sind, spricht man auch von allgegenwärtigem oder ubiquitärem Rechnen ( Ubiquitous computing ). Immer häufiger sind diese Systeme vernetzt, z. B. mit dem Internet („ Internet of Things “). Netzwerke von interagierenden Elementen mit physikalischer Eingabe von und Ausgabe zu ihrer Umwelt werden auch als Cyber-Physical Systems bezeichnet. Ein Beispiel sind drahtlose Sensornetze zur Umweltüberwachung.

Echtzeitsysteme sind darauf ausgelegt, dass sie auf bestimmte zeitkritisch ablaufende Prozesse der Außenwelt mit angemessener Reaktionsgeschwindigkeit rechtzeitig antworten können. Dies setzt voraus, dass die Ausführungszeit der Antwortprozesse entsprechende vorgegebene Zeitschranken garantiert nicht überschreitet. Viele eingebettete Systeme sind auch Echtzeitsysteme.

Eine zentrale Rolle bei allen Mehrrechnersystemen spielt die Rechnerkommunikation. Diese ermöglicht den elektronischen Datenaustausch zwischen Computern und stellt damit die technische Grundlage des Internets dar. Neben der Entwicklung von Routern , Switches oder Firewalls , gehört hierzu auch die Entwicklung der Softwarekomponenten, die zum Betrieb dieser Geräte nötig ist. Dies schließt insbesondere die Definition und Standardisierung von Netzwerkprotokollen , wie TCP , HTTP oder SOAP , ein. Protokolle sind dabei die Sprachen, in denen Rechner untereinander Information austauschen.

Bei Verteilten Systemen arbeitet eine große Zahl von Prozessoren ohne gemeinsamen Speicher zusammen. Üblicherweise regeln Prozesse , die über Nachrichten miteinander kommunizieren, die Zusammenarbeit von einzelnen weitgehend unabhängigen Computern in einem Verbund ( Cluster ). Schlagworte in diesem Zusammenhang sind beispielsweise Middleware , Grid-Computing und Cloud Computing .

Modellierung und Bewertung

Als Basis für die Bewertung der genannten Architekturansätze sind – wegen der generellen Komplexität solcher Systemlösungen – spezielle Modellierungsmethoden entwickelt worden, um Bewertungen bereits vor der eigentlichen Systemrealisierung durchführen zu können. Besonders wichtig ist dabei zum einen die Modellierung und Bewertung der resultierenden Systemleistung, z. B. anhand von Benchmark -Programmen. Als Methoden zur Leistungsmodellierung sind z. B. Warteschlangenmodelle , Petri-Netze und spezielle verkehrstheoretische Modelle entwickelt worden. Vielfach wird insbesondere bei der Prozessorentwicklung auch Computersimulation eingesetzt.

Neben der Leistung können auch andere Systemeigenschaften auf der Basis der Modellierung studiert werden; z. B. spielt gegenwärtig auch der Energieverbrauch von Rechnerkomponenten eine immer größere, zu berücksichtigende Rolle. Angesichts des Wachstums der Hardware- und Softwarekomplexität sind außerdem Probleme der Zuverlässigkeit, Fehlerdiagnose und Fehlertoleranz , insbesondere bei sicherheitskritischen Anwendungen, von großer Bedeutung. Hier gibt es entsprechende, meist auf Verwendung redundanter Hardware- bzw. Softwareelemente basierende Lösungsmethoden.

Beziehungen zu anderen Informatikgebieten und weiteren Fachdisziplinen

Die Technische Informatik hat enge Beziehungen zu anderen Gebieten der Informatik und den Ingenieurwissenschaften. Sie baut auf der Elektronik und Schaltungstechnik auf, wobei digitale Schaltungen im Vordergrund stehen ( Digitaltechnik ). Für die höheren Softwareschichten stellt sie die Schnittstellen bereit, auf denen wiederum diese Schichten aufbauen. Insbesondere über eingebettete Systeme und Echtzeitsysteme gibt es enge Beziehungen zu angrenzenden Gebieten der Elektrotechnik und des Maschinenbaus wie Steuerungs- , Regelungs- und Automatisierungstechnik sowie zur Robotik .

Informatik in interdisziplinären Wissenschaften

Unter dem Sammelbegriff der Angewandten Informatik „fasst man das Anwenden von Methoden der Kerninformatik in anderen Wissenschaften … zusammen“ . [1] Rund um die Informatik haben sich einige interdisziplinäre Teilgebiete und Forschungsansätze entwickelt, teilweise zu eigenen Wissenschaften . Beispiele:

Computational sciences

Dieses interdisziplinäre Feld beschäftigt sich mit der computergestützten Analyse, Modellierung und Simulation von naturwissenschaftlichen Problemen und Prozessen. Entsprechend den Naturwissenschaften wird hier unterschieden:

- Die Bioinformatik (englisch bioinformatics , auch computational biology ) befasst sich mit den informatischen Grundlagen und Anwendungen der Speicherung, Organisation und Analyse biologischer Daten . Die ersten reinen Bioinformatikanwendungen wurden für die DNA -Sequenzanalyse entwickelt. Dabei geht es primär um das schnelle Auffinden von Mustern in langen DNA-Sequenzen und die Lösung des Problems, wie man zwei oder mehr ähnliche Sequenzen so übereinander legt und gegeneinander ausrichtet, dass man eine möglichst optimale Übereinstimmung erzielt ( sequence alignment ). Mit der Aufklärung und weitreichenden Funktionsanalyse verschiedener vollständiger Genome (z. B. des Fadenwurms Caenorhabditis elegans ) verlagert sich der Schwerpunkt bioinformatischer Arbeit auf Fragestellungen der Proteomik , wie z. B. dem Problem der Proteinfaltung und Strukturvorhersage , also der Frage nach der Sekundär- oder Tertiärstruktur bei gegebener Aminosäuresequenz.

- Die Biodiversitätsinformatik umfasst die Speicherung und Verarbeitung von Informationen zur biologischen Vielfalt. Während die Bioinformatik sich mit Nucleinsäuren und Proteinen beschäftigt, sind die Objekte der Biodiversitätsinformatik Taxa , biologische Sammlungsbelege und Beobachtungsdaten.

- Künstliches Leben (englisch Artificial life ) wurde 1986 als interdisziplinäre Forschungsdisziplin etabliert. [20] [21] Die Simulation natürlicher Lebensformen mit Software- ( soft artificial life ) und Hardwaremethoden ( hard artificial life ) ist ein Hauptziel dieser Disziplin. [22] Anwendungen für künstliches Leben gibt es heute unter anderem in der synthetischen Biologie, im Gesundheitssektor und der Medizin, in der Ökologie, bei autonomen Robotern, im Transport- und Verkehrssektor, in der Computergrafik, für virtuelle Gesellschaften und bei Computerspielen. [23]

- Die Chemoinformatik (englisch chemoinformatics , cheminformatics oder chemiinformatics ) bezeichnet einen Wissenschaftszweig, der das Gebiet der Chemie mit Methoden der Informatik verbindet und umgekehrt. Sie beschäftigt sich mit der Suche im chemischen Raum , welcher aus virtuellen ( in silico ) oder realen Molekülen besteht. Die Größe des chemischen Raumes wird auf etwa 10 62 Moleküle geschätzt und ist weit größer als die Menge der bisher real synthetisierten Moleküle. Somit lassen sich unter Umständen Millionen von Molekülen mit Hilfe solcher Computer-Methoden in silico testen, ohne diese explizit mittels Methoden der Kombinatorischen Chemie oder Synthese im Labor erzeugen zu müssen.

Ingenieurinformatik, Maschinenbauinformatik

Die Ingenieurinformatik , englisch auch als Computational Engineering Science bezeichnet, ist eine interdisziplinäre Lehre an der Schnittstelle zwischen den Ingenieurwissenschaften , der Mathematik und der Informatik an den Fachbereichen Elektrotechnik , Maschinenbau , Verfahrenstechnik , Systemtechnik .

Die Maschinenbauinformatik beinhaltet im Kern die virtuelle Produktentwicklung ( Produktionsinformatik ) mittels Computervisualistik , sowie die Automatisierungstechnik .

Wirtschaftsinformatik, Informationsmanagement

Die Wirtschaftsinformatik (englisch (business) information systems , auch management information systems ) ist eine „Schnittstellen-Disziplin“ zwischen der Informatik und den Wirtschaftswissenschaften , besonders der Betriebswirtschaftslehre . Sie hat sich durch ihre Schnittstellen zu einer eigenständigen Wissenschaft entwickelt und kann sowohl an Wirtschafts- als auch an Informatik- Fakultäten studiert werden. Ein Schwerpunkt der Wirtschaftsinformatik liegt auf der Abbildung von Geschäftsprozessen und der Buchhaltung in relationalen Datenbanksystemen und Enterprise-Resource-Planning -Systemen. Das Information Engineering der Informationssysteme und das Informationsmanagement spielen im Rahmen der Wirtschaftsinformatik eine gewichtige Rolle. Entwickelt wurde dies an der Fachhochschule Furtwangen bereits 1971. [13] Ab 1974 richteten die damalige TH Darmstadt, die Johannes-Kepler-Universität Linz und die TU Wien einen Studiengang Wirtschaftsinformatik ein.

Sozioinformatik

Die Sozioinformatik befasst sich mit den Auswirkungen von IT-Systemen auf die Gesellschaft, wie sie z. B. Organisationen und Gesellschaft in ihrer Organisation unterstützen, aber auch wie die Gesellschaft auf die Entwicklung von sozial eingebetteten IT-Systemen einwirkt, sei es als Prosumenten auf kollaborativen Plattformen wie der Wikipedia, oder mittels rechtlicher Einschränkungen, um beispielsweise Datensicherheit zu garantieren.

Sozialinformatik

Die Sozialinformatik befasst sich zum einen mit dem IT-Betrieb in sozialen Organisationen, zum anderen mit Technik und Informatik als Instrument der Sozialen Arbeit, wie zum Beispiel beim Ambient Assisted Living .

Medieninformatik

Die Medieninformatik hat die Schnittstelle zwischen Mensch und Maschine als Schwerpunkt und befasst sich mit der Verbindung von Informatik, Psychologie , Arbeitswissenschaft , Medientechnik , Mediengestaltung und Didaktik .

Computerlinguistik

In der Computerlinguistik wird untersucht, wie natürliche Sprache mit dem Computer verarbeitet werden kann. Sie ist ein Teilbereich der Künstlichen Intelligenz , aber auch gleichzeitig Schnittstelle zwischen Angewandter Linguistik und Angewandter Informatik . Verwandt dazu ist auch der Begriff der Kognitionswissenschaft , die einen eigenen interdisziplinären Wissenschaftszweig darstellt, der ua Linguistik , Informatik, Philosophie , Psychologie und Neurologie verbindet. Anwendungsgebiete der Computerlinguistik sind die Spracherkennung und -synthese , automatische Übersetzung in andere Sprachen und Informationsextraktion aus Texten.

Umweltinformatik, Geoinformatik

Die Umweltinformatik beschäftigt sich interdisziplinär mit der Analyse und Bewertung von Umweltsachverhalten mit Mitteln der Informatik. Schwerpunkte sind die Verwendung von Simulationsprogrammen , Geographische Informationssysteme (GIS) und Datenbanksysteme.

Die Geoinformatik (englisch geoinformatics ) ist die Lehre des Wesens und der Funktion der Geoinformation und ihrer Bereitstellung in Form von Geodaten und mit den darauf aufbauenden Anwendungen auseinander. Sie bildet die wissenschaftliche Grundlage für Geoinformationssysteme (GIS). Allen Anwendungen der Geoinformatik gemeinsam ist der Raumbezug und fallweise dessen Abbildung in kartesische räumliche oder planare Darstellungen im Bezugssystem .

Andere Informatikdisziplinen

Weitere Schnittstellen der Informatik zu anderen Disziplinen gibt es in der Informationswirtschaft , Medizinischen Informatik , Logistikinformatik , Pflegeinformatik und der Rechtsinformatik , Informationsmanagement ( Verwaltungsinformatik , Betriebsinformatik ), Architekturinformatik ( Bauinformatik ) sowie der Agrarinformatik , Archäoinformatik , Sportinformatik , sowie neue interdisziplinäre Richtungen wie beispielsweise das Neuromorphic Engineering . Die Zusammenarbeit mit der Mathematik oder der Elektrotechnik wird aufgrund der Verwandtschaft nicht als interdisziplinär bezeichnet. Mit dem Informatikunterricht , besonders an Schulen, befasst sich die Didaktik der Informatik . Die Elementarinformatik beschäftigt sich mit der Vermittlung von grundlegenden Informatikkonzepten im Vorschul- und Grundschulbereich.

Künstliche Intelligenz

Die Künstliche Intelligenz (KI) ist ein großes Teilgebiet der Informatik mit starken Einflüssen aus Logik , Linguistik , Neurophysiologie und Kognitionspsychologie . Dabei unterscheidet sich die KI in der Methodik zum Teil erheblich von der klassischen Informatik. Statt eine vollständige Lösungsbeschreibung vorzugeben, wird in der Künstlichen Intelligenz die Lösungsfindung dem Computer selbst überlassen. Ihre Verfahren finden Anwendung in Expertensystemen , in der Sensorik und Robotik .

Im Verständnis des Begriffs „Künstliche Intelligenz“ spiegelt sich oft die aus der Aufklärung stammende Vorstellung vom Menschen als Maschine wider, dessen Nachahmung sich die sogenannte „starke KI“ zum Ziel setzt: eine Intelligenz zu erschaffen, die wie der Mensch nachdenken und Probleme lösen kann und die sich durch eine Form von Bewusstsein beziehungsweise Selbstbewusstsein sowie Emotionen auszeichnet.

Die Umsetzung dieses Ansatzes erfolgte durch Expertensysteme, die im Wesentlichen die Erfassung, Verwaltung und Anwendung einer Vielzahl von Regeln zu einem bestimmten Gegenstand (daher „Experten“) leisten.

Im Gegensatz zur starken KI geht es der „schwachen KI“ darum, konkrete Anwendungsprobleme zu meistern. Insbesondere sind dabei solche Anwendungen von Interesse, zu deren Lösung nach allgemeinem Verständnis eine Form von „ Intelligenz “ notwendig scheint. Letztlich geht es der schwachen KI somit um die Simulation intelligenten Verhaltens mit Mitteln der Mathematik und der Informatik; es geht ihr nicht um Schaffung von Bewusstsein oder um ein tieferes Verständnis der Intelligenz. Ein Beispiel aus der schwachen KI ist die Fuzzylogik .

Neuronale Netze gehören ebenfalls in diese Kategorie – seit Anfang der 1980er Jahre analysiert man unter diesem Begriff die Informationsarchitektur des (menschlichen oder tierischen) Gehirns. Die Modellierung in Form künstlicher neuronaler Netze illustriert, wie aus einer sehr einfachen Grundstruktur eine komplexe Mustererkennung geleistet werden kann. Gleichzeitig wird deutlich, dass diese Art von Lernen nicht auf der Herleitung von logisch oder sprachlich formulierbaren Regeln beruht – und somit etwa auch die besonderen Fähigkeiten des menschlichen Gehirns innerhalb des Tierreichs nicht auf einen regel- oder sprachbasierten „Intelligenz“-Begriff reduzierbar sind. Die Auswirkungen dieser Einsichten auf die KI-Forschung, aber auch auf Lerntheorie , Didaktik und andere Gebiete werden noch diskutiert.

Während die starke KI an ihrer philosophischen Fragestellung bis heute scheiterte, sind auf der Seite der schwachen KI Fortschritte erzielt worden.

Informatik und Gesellschaft

„Informatik und Gesellschaft“ (IuG) ist ein Teilbereich der Wissenschaft Informatik und erforscht die Rolle der Informatik auf dem Weg zur Informationsgesellschaft. Die dabei untersuchten Wechselwirkungen der Informatik umfassen die unterschiedlichsten Aspekte. Ausgehend von historischen, sozialen, kulturellen Fragen betrifft dies ökonomische, politische, ökologische, ethische, didaktische und selbstverständlich technische Aspekte. Die entstehende global vernetzte Informationsgesellschaft wird für die Informatik als zentrale Herausforderung gesehen, in der sie als technische Grundlagenwissenschaft eine definierende Rolle spielt und diese reflektieren muss. IuG ist dadurch gekennzeichnet, dass eine interdisziplinäre Herangehensweise, insbesondere mit den Geisteswissenschaften, aber auch z. B. mit den Rechtswissenschaften notwendig ist.

Siehe auch

- Liste bedeutender Personen für die Informatik

- Gesellschaft für Informatik , Österreichische Computer Gesellschaft , Schweizer Informatik Gesellschaft

- Informatikstudium

Literatur

- Herbert Bruderer: Meilensteine der Rechentechnik . Band 1: Mechanische Rechenmaschinen, Rechenschieber, historische Automaten und wissenschaftliche Instrumente, 2., stark erw. Auflage, Walter de Gruyter, Berlin/Boston 2018, ISBN 978-3-11-051827-6 .

- Heinz-Peter Gumm, Manfred Sommer: Einführung in die Informatik . 10. Auflage. Oldenbourg, München 2012, ISBN 978-3-486-70641-3 .

- AK Dewdney: Der Turing Omnibus: Eine Reise durch die Informatik mit 66 Stationen. Übersetzt von P. Dobrowolski. Springer, Berlin 1995, ISBN 3-540-57780-7 .

- Hans Dieter Hellige (Hrsg.): Geschichten der Informatik. Visionen, Paradigmen, Leitmotive. Berlin, Springer 2004, ISBN 3-540-00217-0 .

- Jan Leeuwen: Theoretical Computer Science. Springer, Berlin 2000, ISBN 3-540-67823-9 .

- Peter Rechenberg, Gustav Pomberger (Hrsg.): Informatik-Handbuch. 3. Auflage. Hanser 2002, ISBN 3-446-21842-4 .

- Vladimiro Sassone: Foundations of Software Science and Computation Structures. Springer, Berlin 2005, ISBN 3-540-25388-2 .

- Uwe Schneider, Dieter Werner (Hrsg.): Taschenbuch der Informatik. 6. Auflage. Fachbuchverlag, Leipzig 2007, ISBN 978-3-446-40754-1 .

- Gesellschaft für Informatik : Was ist Informatik? Positionspapier der Gesellschaft für Informatik. (PDF, ca. 600 kB) Bonn 2005., oder Was ist Informatik? Kurzfassung. (PDF; rund 85 kB).

- Les Goldschlager, Andrew Lister: Informatik – Eine moderne Einführung. Carl Hanser, Wien 1986, ISBN 3-446-14549-4 .

- Arno Schulz : Informatik für Anwender. de Gruyter Verlag, Berlin, New York 1973, ISBN 3-11-002051-3 .

- Horst Völz : Das ist Information. Shaker Verlag, Aachen 2017. ISBN 978-3-8440-5587-0 .

- Horst Völz : Wie wir wissend wurden. Nicht Alles ist Information. Shaker Verlag, Aachen 2018. ISBN 978-3-8440-5865-9 .

- Horst Völz : Information und Medienwissenschaft. Shaker Verlag, Düren 2020. ISBN 978-3-8440-7641-7 .

Weblinks

- Linkkatalog zum Thema Informatik-Fachbereiche an Hochschulen bei curlie.org (ehemals DMOZ )

- Gesellschaft für Informatik (GI)

- Schweizer Informatik Gesellschaft (SI)

- Informatik für Lehrerinnen und Lehrer im ZUM -Wiki

- “Einstieg Informatik” www.einstieg-informatik.de

Einzelnachweise

- ↑ a b Duden Informatik A – Z: Fachlexikon für Studium, Ausbildung und Beruf, 4. Aufl., Mannheim 2006. ISBN 978-3-411-05234-9 .

- ↑ Gesellschaft für Informatik: Was ist Informatik? Unser Positionspapier, S. 8 ff. Abgerufen am 9. Februar 2021 .

- ↑ Friedrich L. Bauer: Historische Notizen zur Informatik . Springer Science & Business Media, 2009, ISBN 978-3-540-85789-1 , S. 36 ( eingeschränkte Vorschau in der Google-Buchsuche [abgerufen am 25. Februar 2017]).

- ↑ Arno Pasternak: Fach- und bildungswissenschaftliche Grundlagen für den Informatikunterricht in der Sekundarstufe I (Dissertation). (PDF; 14,0 MB) 17. Mai 2013, S. 47 , abgerufen am 31. Juli 2020 (mit einem Faksimile des einleitenden Abschnitts aus den SEG-Nachrichten 4/1957).

- ↑ Tobias Häberlein: Eine praktische Einführung in die Informatik mit Bash und Python . Oldenbourg Verlag, 2011, ISBN 978-3-486-71445-6 , S. 5 ( eingeschränkte Vorschau in der Google-Buchsuche [abgerufen am 25. Februar 2017]).

- ↑ Präsentation zur 40-jährigen Geschichte der GI und der Informatik ( Memento vom 23. Dezember 2012 im Internet Archive ) (PDF; 3,1 MB)

- ↑ Friedrich L. Bauer: Historische Notizen zur Informatik . Springer Science & Business Media, 2009, ISBN 978-3-540-85789-1 , S. 36 ( eingeschränkte Vorschau in der Google-Buchsuche [abgerufen am 25. Februar 2017]).

- ↑ Wolfgang Coy : Geschichten der Informatik. Visionen, Paradigmen, Leitmotive . Hrsg.: Hans Dieter Hellige. Springer, 2004, ISBN 3-540-00217-0 , S. 475 .

- ↑ Start of study as from winter semester 2012/2013 – Fakultät für Informatik der Technischen Universität München. In: www.in.tum.de. Abgerufen am 7. September 2015 .

- ↑ a b c d Christine Pieper: Hochschulinformatik in der Bundesrepublik und der DDR bis 1989/1990 . In: Wissenschaft, Politik und Gesellschaft . 1. Auflage. Franz Steiner Verlag, Stuttgart 2009, ISBN 978-3-515-09363-7 .

- ↑ Fakultät für Informatik: Geschichte. Abgerufen am 13. September 2019 .

- ↑ 40 Jahre Informatik in München: 1967–2007 / Festschrift ( Memento vom 17. Mai 2011 im Internet Archive ) (PDF) S. 26 auf in.tum.de , abgerufen am 5. Januar 2014.

- ↑ a b Geschichte der HS Furtwangen

- ↑ Geschichte des Universitätsbereichs im KIT

- ↑ https://www.jku.at/die-jku/ueber-uns/geschichte/

- ↑ Kurze Geschichte der Technischen Universität Wien ( Memento vom 5. Juni 2012 im Internet Archive )

- ↑ University of Cambridge: A brief informal history of the Computer Laboratory

- ↑ University of Cambridge: Cambridge Computing: The First 75 Years , S. 96.

- ↑ Konrad Zuse – der Namenspatron des ZIB (abgerufen am 27. Juli 2012)

- ↑ Christopher Langton: Studying Artificial Life with Cellular Automata. In: Physics 22ID:120-149

- ↑ Christopher Langton: What is Artificial Life? (1987) pdf ( Memento vom 11. März 2007 im Internet Archive )

- ↑ Marc A. Bedau: Artificial life: organization, adaptation and complexity from the bottom up

- ↑ Wolfgang Banzhaf, Barry McMullin: Artificial Life. In: Grzegorz Rozenberg, Thomas Bäck, Joost N. Kok (Hrsg.): Handbook of Natural Computing. Springer 2012. ISBN 978-3-540-92909-3 (Print), ISBN 978-3-540-92910-9 (Online)

- Informatik

- Wissenschaftliches Fachgebiet

- Kofferwort