Harddisk

|

Lagringsmedium

Harddisk

|

|

Åpen harddisk: tre magnetiske disker, lese / skrivehode, mekanikk |

|

| Generell | |

|---|---|

| Type | magnetisk |

| kapasitet | opptil 20 terabyte (2020) |

| opprinnelse | |

| utvikler | IBM |

| fantasi | 1956 |

| forgjenger | Trommelagring (delvis magnetbånd ) |

En harddisk ( engelsk harddisk, forkortelse HDD), ofte referert til som harddisk eller harddisk (forkortet HD), en er magnetisk lagringsmedium for datateknologi , der data på overflaten av roterende disker (også engelsk " Tallerken "kalt) skrives. For skrivning, hard-magnetisk blir belegget på plateoverflaten magnetisert uten kontakt i samsvar med den informasjon som skal registreres. Remanensen (gjenværende magnetisering) lagrer informasjonen. Informasjonen leses ved berøring uten skanning av magnetiseringen av diskoverflaten.

I motsetning til sekvensielt adresserte lagringsmedier som magnetbånd eller hullet tape , er harddisker klassifisert som lagringsenheter med direkte tilgang ( DASD ), siden det ikke er nødvendig med lineær passasje for å komme til et bestemt lagringssted. Før de ble brukt i PC -sektoren fra 1980 -tallet, ble harddisker hovedsakelig brukt i mainframesektoren . Dataene kan lagres på harddiskene i forskjellige organisasjonsformer. CKD (tell nøkkeldata) organiserte harddisker inneholder datablokker av forskjellige lengder avhengig av postformatet. FBA (fix block architecture) organiserte harddisker inneholder datablokker av samme lengde, som vanligvis er 512 eller 4096 byte i størrelse. En tilgang må alltid omfatte et helt antall blokker.

Siden 2007 har flashminner (såkalte solid-state-stasjoner eller SSD for korte) og hybridminner (kombinasjoner av SSD og konvensjonelle harddisker) også blitt tilbudt i sluttkundemarkedet, som også blir adressert og forenklet via samme grensesnitt (spesifikasjon i henhold til SATA , etc.) referert til som "harddisker". En billig stasjonær SSD (fra august 2020) er rundt tre ganger så dyr per terabyte som en billig konvensjonell stasjonær harddisk, men oppnår betydelig lavere tilgangstider og høyere skrive- og lesehastigheter. [1] [2] På grunn av den lavere prisen per lagringsenhet, er konvensjonelle harddisker fortsatt mye brukt, spesielt i applikasjoner som krever høy kapasitet, men ikke høye hastigheter (f.eks. Når de brukes i NAS for medielagring i private omgivelser).

Begrepet "harddisk" beskriver på den ene siden at magnetisk disk, i motsetning til " flyttbar disk ", er permanent koblet til stasjonen eller datamaskinen. På den annen side tilsvarer det det engelske uttrykket “harddisk”, som, i motsetning til fleksible ( diskett ) disker på diskett, er laget av stivt materiale. [3] Følgelig var stiv plate også i bruk fram til 1990 -tallet.

Generelle tekniske data

Harddisker er utstyrt med en tilgangsstruktur gjennom (såkalt " lavt nivå ") formatering . Siden begynnelsen av 1990 -tallet med fremkomsten av IDE -harddisker har dette blitt gjort av produsenten og kan bare gjøres av produsenten. Begrepet "formatering" brukes også for å lage et filsystem (" formatering på høyt nivå ").

Med formatering på lavt nivå skrives forskjellige markeringer og sektoroverskriftene som inneholder spor- og sektornumre for navigering. Servoinformasjonen som kreves for gjeldende harddisker med lineære motorer kan ikke skrives av brukeren. Servoinformasjon er nødvendig for at hodet på en pålitelig måte kan følge "sporet". Rent mekanisk styring er ikke lenger mulig med en høyere banetetthet og er for upresis - med en sporetetthet på 5,3 spor / µm er et spor bare 190 nm bredt.

Lagringskapasitet

Lagringskapasiteten til en harddisk beregnes ut fra størrelsen på en datablokk (256, 512, 2048 eller 4096 byte) multiplisert med antall tilgjengelige blokker. Størrelsen på de første harddiskene ble gitt i megabyte, fra rundt 1997 i gigabyte, og disker i terabyte -området siden rundt 2008.

Var på hvilken måte dataene på de første diskene ble lagret var fortsatt "synlig fra utsiden" (harddisken kontrolleren , firmware som BIOS på en IBM PC-kompatibel datamaskin og operativsystem , sektorer per spor , antall spor, antall hoder, MFM- eller RLL -modulering ), dette endret seg med introduksjonen av IDE -disker på begynnelsen av 1990 -tallet. Det var mindre og mindre å se hvordan dataene lagres internt; panelet blir adressert via et grensesnitt som skjuler innvendig fra utsiden. Noen ganger rapporterte harddisken "feil" informasjon om antall spor, sektorer og hoder for å omgå systembegrensninger: Fastvare og operativsystem fungerte på grunnlag av disse "feil" verdiene, harddisklogikken konverterte dem deretter til interne verdier Som faktisk tilsvarte sin egen geometri .

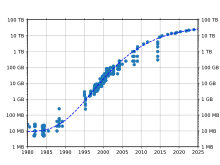

Utviklingen av maksimal harddiskkapasitet over tid viser en nesten eksponentiell kurs, som kan sammenlignes med utviklingen av datakraft i henhold til Moores lov . Kapasiteten har doblet seg omtrent hver 16. måned med litt fallende priser, med kapasitetsøkning siden ca 2005 (januar 2007: 1 terabyte, [4] september 2011: 4 terabyte, desember 2019: 16 terabyte [5] ).

Harddiskprodusenter bruker prefikser i sin SI-kompatible desimalbetydning for lagringskapasitet. En kapasitet på en terabyte indikerer en kapasitet på 10 12 byte. Microsoft Windows -operativsystemet og noen andre eldre operativsystemer bruker de samme prefiksene når de spesifiserer kapasiteten til harddisker, men etter historisk bruk, men i motsetning til IEC -standardiseringen som har vært i kraft siden 1998 - i sin binære betydning. Dette fører til en tilsynelatende motsetning mellom størrelsen som er angitt av produsenten og størrelsen på operativsystemet. For eksempel spesifiserer operativsystemet bare en kapasitet på 931 "gigabyte" for en harddisk med en kapasitet på en terabyte spesifisert av produsenten, siden en "terabyte" der angir 2 40 byte (IEC-kompatibelt navn for 2 40 byte er tebibyte ). Denne effekten forekommer ikke under de IEC-kompatible systemene OS X (fra versjon 10.6 ) og Unix eller de fleste Unix-lignende operativsystemene.

Størrelser (mekanisk)

Dimensjonene til harddisker er tradisjonelt angitt i tommer . Dette er ikke en eksakt størrelsesspesifikasjon, men en formfaktor . Vanlige formfaktorer for bredden er 5,25 ", 3,5", 2,5 "og 1,8", for høyden z. B. 1 ″, 1 ⁄ 2 ″ og 3 ⁄ 8 ″. Tommer tilsvarer vanligvis omtrent tallerkenens diameter, ikke bredden på drivhuset. I noen tilfeller brukes imidlertid mindre tallerkener for å muliggjøre høyere hastigheter. [6]

I løpet av tekniske fremskritt ble størrelser gjentatte ganger avbrutt til fordel for mindre, ettersom disse, i tillegg til det mindre plassbehovet, er mindre utsatt for vibrasjoner og har et lavere strømforbruk . Riktignok betyr mindre plass i utgangspunktet at en stasjon har mindre fat og dermed gir mindre lagringsplass. Erfaringen viser imidlertid at den raske teknologiske utviklingen i retning av høyere datatetthet kompenserer for denne begrensningen på kort sikt.

Den første IBM 350 -harddiskstasjonen fra 1956 var et skap med en 24 "diskstabel. På midten av 1970-tallet dukket det opp modeller med en størrelse på 8 ", som relativt raskt ble erstattet av mye mer håndterbare og fremfor alt lettere 5,25" harddiskstasjoner. I mellomtiden var det fortsatt størrelser på 14 "og 9".

5,25 ″ harddisker ble introdusert av ( Shugart Technology) Seagate i 1980; platene deres er omtrent på størrelse med en CD / DVD / Blu-Ray. Denne størrelsen har ikke blitt produsert siden 1997. Noen SCSI- serverstasjoner og LowCost- ATA- stasjonen BigFoot Quantum er de siste representantene for dette formatet. Størrelsen på disse stasjonene er basert på størrelsen på 5,25 "diskettstasjoner: Bredden på disse stasjonene er 5 3 ⁄ 4 "(146 mm), høyden for stasjoner i full høyde 3 1 ⁄ 4 ″ (82,6 mm), for stasjoner med halv høyde 1 5 ⁄ 8 ″ (41,3 mm). Det var modeller med en enda lavere byggehøyde: modellene til det BigFoot serien hadde en total høyde på 3/4 "(19 mm) og 1" (25,4 mm). Dybden på 5,25 "harddisker er ikke spesifisert, men bør ikke være vesentlig mer enn 200 mm.

3,5 ″ harddisker ble introdusert av IBM i 1987 med PS / 2 -serien og var standard på stasjonære datamaskiner i lang tid. Størrelsen på disse stasjonene er basert på størrelsen på 3,5 ″ diskettstasjoner : Bredden på disse stasjonene er 4 ″ (101,6 mm), høyden er vanligvis 1 ″ (25,4 mm). Seagate tok frem en harddisk med tolv disker og 1,6 ″ (40,64 mm) høy med ST1181677; Fujitsu tilbød også stasjoner av denne størrelsen. [7] Dybden på 3,5 ″ harddisker er 146 mm (5 ″).

På mange områder har 3,5 "harddisker i stor grad blitt erstattet av 2,5" modeller eller SSD -er.

2,5 ″ harddisker ble opprinnelig utviklet for bærbare datamaskiner, og fantes da hovedsakelig på servere og spesialenheter (multimediaspillere, USB -harddisker); de er nå utbredt. Bredden er 70 mm, dybden 100 mm. Den tradisjonelle høyde var 1/2 "(12,7 mm); I mellomtiden er det konstruksjonshøyder mellom 5 mm og 15 mm, 5 mm, 7 mm og 9,5 mm er vanlige. Den tillatte høyden avhenger av enheten som harddisken skal installeres i. Grensesnittforbindelsen er modifisert i forhold til de større designene; med ATA reduseres avstanden mellom pinnene fra 2,54 mm til 2 mm. Det er også fire pinner (totalt 43 pinner), som erstatter den separate strømforsyningskontakten til de større modellene. 2,5 ″ harddisker krever bare en driftsspenning på 5 V; den andre driftsspenningen på 12 V som kreves for større paneler er ikke nødvendig. 2,5 ″ SATA-harddisker har de samme tilkoblingene som 3,5 ″ -stasjonene, bare de 5 mm høye stasjonene har delvis en spesiell SFF-8784-tilkobling på grunn av den lave høyden som er tilgjengelig. [Åttende]

Seagate, Toshiba , Hitachi og Fujitsu har tilbudt 2,5 "harddisker for bruk i servere siden 2006. Siden april 2008 har Western Digital markedsført Velociraptor, en 2,5 "harddisk (med en høyde på 15 mm) med en 3,5" monteringsramme som en stasjonær harddisk. [9]

| Form- faktor |

høyde (mm) |

bred (mm) |

dybde (mm) |

|---|---|---|---|

| 5,25 ″ | ≤82,6 | 146 | > 200 |

| 3,5 ″ | 25,4 | 101,6 | 146 |

| 2,5 ″ | 12,7 | 70 | 100 |

| 1,8 tommer | 8 | 54 | 71-78,5 |

1,8 ″ harddisker har blitt brukt i subnotebooks , ulike industrielle applikasjoner og store MP3 -spillere siden 2003. Bredden er 54 mm, dybden mellom 71 og 78,5 mm, høyden 8 mm.

Selv mindre størrelser med 1,3 ″, 1 ″ og 0,85 ″ spiller neppe noen rolle. Mikrodriver var et unntak i de tidlige dagene av digital fotografering - med en størrelse på 1 ″ muliggjorde de relativt høye og rimelige minnekort i CompactFlash Type II -format for digitale kameraer , men har siden blitt erstattet av blitsminner . I 2005 tilbød Toshiba harddisker med en størrelse på 0,85 ″ og en kapasitet på 4 gigabyte for applikasjoner som MP3 -spillere.

Oppsett og funksjon

Fysisk struktur av enheten

En harddisk består av følgende enheter:

- en eller flere dreibart festet disker (tallerken, plural: Platters),

- en akse, også kalt spindel , hvor skivene er montert over hverandre,

- en elektrisk motor som en stasjon for spindelen (og dermed disken (e)),

- bevegelige lese- / skrivehoder ,

- Ett lager hver for spindelen (for det meste hydrodynamiske glidelagre ) og for aktuatoraksen (og dermed lese / skrivehodene) (også magnetiske lagre ),

- en stasjon for aktuatoraksen (og dermed for lese-skrivehodene) (ger.: Aktuator, tysk: aktuator )

- kontrollelektronikken for motor- og hodekontroll,

- en DSP for administrasjon, drift av grensesnittet, kontroll av lese / skrivehodene. Modulering og demodulering av signalene fra lese- / skrivehodene utføres av integrert spesiell maskinvare og utføres ikke direkte av DSP. Den nødvendige prosessorkraften for demoduleringen er i området ~ 10 7 MIPS .

- ( Flash ) ROM og DDR-RAM for fastvare , midlertidige data og harddiskbuffer . For tiden er 2 til 64 MiB vanlige .

- grensesnittet for adressering av harddisken fra utsiden og

- et stabilt hus .

Teknisk struktur og materiale for datadiskene

Siden det magnetiserbare laget skal være spesielt tynt, består platene av et ikke-magnetiserbart grunnmateriale med et tynt magnetiserbart dekklag. Overflatebehandlede aluminiumlegeringer blir ofte benyttet som basismateriale. Når det gjelder ruter med høy datatetthet, brukes imidlertid først og fremst magnesiumlegeringer , glass eller glasskompositter, ettersom disse materialene viser mindre diffusjon. [10] [11] De må være dimensjonsstabile (både under mekanisk og termisk belastning) og ha lav elektrisk ledningsevne for å holde størrelsen på virvelstrømmene lave.

Et jernoksid eller kobolt toppstrøk på omtrent en mikrometer tykt påføres rutene. Dagens harddisker produseres ved å sputtere såkalte “high storage density media” som CoCrPt. [12] Det magnetiske laget er i tillegg utstyrt med et beskyttende lag av diamantlignende karbon ("carbon overcoat") for å unngå mekanisk skade. Det er også et 0,5–1,5 nm tykt glidende lag på toppen. [13] Den fremtidige nedbemanning av de magnetiske "bitene" krever forskning på "ultrahøy lagringstetthet" så vel som alternative konsepter ettersom den superparamagnetiske grensen sakte nærmer seg. I tillegg ble det oppnådd en økning i datatetthet gjennom bedre bærermateriale og gjennom optimalisering av skriveprosessen .

Glass ble brukt som materiale for rutene i IBM stasjonære harddisker fra 2000 til 2002 (Deskstar 75GXP / 40GV DTLA-30xxxx , Deskstar 60GXP / 120GXP IC35Lxxxx ). Nyere modeller av harddiskdivisjonen fra IBM (overtatt av Hitachi i 2003) bruker imidlertid aluminium igjen med unntak av serverharddisker. En eller flere roterende disker som ligger over hverandre er plassert i harddiskhuset. Hittil har harddisker med opptil tolv disker blitt bygget, en til fire er for tiden vanlige. Energiforbruk og støyproduksjon i en harddiskfamilie øker med antall disker. Det er vanlig å bruke alle flatene på platene (n disker, 2n overflater og lese / skrivehoder). Noen stasjonsstørrelser (f.eks. 320 GB -stasjon med 250 GB / disk) klarer seg med et ujevnt antall lese- / skrivehoder (her: 3) og bruker ikke en overflate.

- Defekte harddisker

Med erstatning av Longitudinal Magnetic Recording by Perpendicular Magnetic Recording (PMR) - et lagringsprinsipp kjent siden 1970 -tallet, men ennå ikke mestret den gangen - har intensiv forskning siden 2000 gjort det mulig å øke datatettheten ytterligere. Den første harddisken med denne lagringsteknologien kom fra Hitachi i 2005: en 1,8 "harddisk med 60 gigabyte. De fleste harddisker har brukt denne teknologien siden 2008 (fra 200 GB / disk på 3,5 ″). Siden rundt 2014 har noen stasjoner brukt Shingled Magnetic Recording (SMR), der et dataspor strekker seg inn i sine to nabospor ; I dette tilfellet må flere parallelle spor må skrives sammen eller nabospor må repareres etter skriving, noe som fører til en lavere effektiv skrive datahastighet. Dette muliggjør 3,5 ″ harddisker med en kapasitet på over 12 TB (status: 12/2017). Ved å bruke "todimensjonal magnetisk opptak " (TDMR) kan datatettheten økes med ytterligere 10%, men dette krever flere lesehoder per side og mer kompleks elektronikk, og derfor er bruk av dyre stasjoner med veldig stor kapasitet reservert.

Akselagre og hastigheter

Harddisker som brukes i personlige datamaskiner eller hjemme -PCer - for tiden stort sett plater med ATA , SATA , SCSI eller SAS -grensesnitt - roterer med hastigheter fra 5.400 til 10.000 min -1. I feltet av høy ytelse datamaskiner og serverharddisker er hovedsakelig brukes, 10000 eller 15000 rekkevidde min-1. I 2,5 -tommers harddisker for mobile enheter er spindelhastigheter i området fra 5400 til 7200 min -1 , som er meget utbredt 5400 min -1. Hastigheten må følges med høy presisjon, da den bestemmer lengden på litt over tid; Som med hodeposisjonering brukes også en kontrollsløyfe her. Servo brukt.

Aksene til platene til tidligere harddisker (opptil 2000) var kulelagre ; Nylig brukes hovedsakelig hydrodynamiske glidelagre ("fluid dynamic bearing" - FDB). Disse er preget av lengre levetid, lavere støygenerering og lavere produksjonskostnader.

Lese / skrive hovedenheten

Lese / skrivehodet ( magnetisk hode ) til skrivefingeren, i prinsippet en liten elektromagnet , magnetiserer bittesmå områder på plateoverflaten annerledes og skriver dermed dataene på harddisken. På grunn av en luftpute som dannes av luftens friksjon på den roterende skiveoverflaten, flyter lese / skrivehodene (se bakkeeffekt ). Flytehøyden i 2000 var i området ca 20 nm. På grunn av denne lille avstanden må luften inne i harddiskhuset ikke inneholde urenheter. Med nyere harddisker med vinkelrett opptaksteknologi krymper denne avstanden til 5 til 6 nm. Foreløpig annonserte disker (2011) med 1 terabyte / disk tillater fortsatt flyhøyder på maksimalt 3 nm slik at signalet ikke svekkes for mye ved tap av avstand . I likhet med halvledere produseres derfor harddisker i rene rom . I denne sammenhengen er bakkeeffekten svært nyttig for å opprettholde riktig flygehøyde til lese / skrivehodet over den roterende skiven.

Fram til omtrent 1994 ble dataene lest opp av induksjonseffekten av magnetfeltet til den magnetiserte overflaten på databæreroverflaten i spolen til lese / skrivehodet. På grunn av den økende datatettheten har imidlertid områdene som individuelle biter er lagret på blitt mindre og mindre på grunn av årene. For å lese opp disse dataene, kreves mindre og mer følsomme lesehoder. Disse ble utviklet etter 1994: MR lesehoder og noen år senere GMR lesehoder ( gigantisk magnetoresistens ). GMR lesehodet er et program innen spintronics .

Plassering av hode

I de tidlige dagene med harddisker ble lese- / skrivehodene styrt av trinnmotorer , som diskettstasjoner , og sporavstanden var fortsatt stor (se også aktuator ). Bevegelige spolesystemer som ble styrt via magnetisk informasjon på en dedikert diskoverflate i en kontrollsløyfe ( dedikert servo ), men reagerte som trinnmotorsystemer sensitivt på forskjellig termisk ekspansjon og mekaniske unøyaktigheter, oppnådde større posisjoneringsnøyaktighet og dermed en høyere banetetthet.

Senere og fremdeles vanlige systemer bruker magnetisk posisjonsinformasjon som er innebygd med jevne mellomrom mellom datasektorene på hver av overflatene ( innebygd servo ). Denne metoden er elektronisk mer kompleks, men mekanisk enklere og veldig ufølsom for forstyrrende påvirkninger. Foran servoinformasjonen er det vanligvis en spesiell markør som bytter hodesignal fra datamodus til servomodus, leser informasjonen, videresender den til posisjoneringen og bytter tilbake til datamodus med en siste markør. Plasseringsnøyaktigheten som oppnås på denne måten er ytterligere under 1 um. Sporetettheten til Hitachi Deskstar 7K500 fra 2005 er 5,3 spor / um og bits tetthet er 34,3 bits / um. Det vil si 182 bits / µm².

Hodestøttesystemer i ett stykke er begrenset i presisjon av treghet i hodearmen. Flertrinnsposisjonering (f.eks. "Triple Stage Actuator" på Western Digital) muliggjør høyere nøyaktighet og dermed høyere datatetthet. [14]

Parkering av hodene

For å beskytte diskoverflatene før lese- / skrivehodene settes på (den såkalte hodekrasjen ), beveger de seg inn i landingssonen før harddisken slås av, der de blir fikset. Hvis forsyningsspenningen plutselig svikter, byttes frekvensomformeren som en generator, og energien som oppnås på denne måten genererer en svingpuls for hodearmen. Denne parkeringen øker slagmotstanden til harddiskene for transport eller modifikasjon. Parkeringsposisjonen kan være utenfor rutene eller inne i panelene. Lese / skrivehodet er plassert på et forhåndsdefinert område på harddisken som ikke inneholder data. Overflaten på dette området er spesielt forbehandlet for å forhindre at hodet klistrer seg fast og gjør at harddisken kan starte på nytt senere. Fikseringen gjøres for eksempel av en magnet som holder lesehodet på plass.

Når det gjelder eldre harddisker, ble lese- / skrivehodene trukket tilbake fra diskstakken på nesten alle modeller. Senere (1990-, 2000 -tallet) ble en innendørs parkeringsplass i økende grad foretrukket. I 2008 forekommer begge variantene. Når det gjelder bærbare disker, gir parkeringsposisjonen utenfor diskbunken ytterligere beskyttelse mot skade på platens overflater under transport (vibrasjon) av harddisken.

Med eldre harddisker måtte hodene parkeres eksplisitt med kommando fra operativsystemet før de ble slått av - steppermotorer krevde mange koordinerte impulser for parkering, som var svært vanskelige eller umulige å generere etter at forsyningsspenningen gikk tapt. Hodene til moderne harddisker kan også parkeres eksplisitt, siden den beskrevne automatiske parkeringsmekanismen kan føre til økt slitasje etter at forsyningsspenningen er slått av. [15] Park -kommandoen utstedes nå automatisk av enhetsdriveren når systemet slås av.

I moderne bærbare datamaskiner sikrer en akselerasjonssensor at harddiskfingeren er parkert under et mulig fritt fall, for å begrense skaden hvis en datamaskin faller.

Harddiskskap

Huset på en harddisk er veldig massivt. Det er vanligvis en støpt del laget av en aluminiumslegering og utstyrt med et deksel av rustfritt stål . Hvis en harddisk åpnes i normal, urenset luft, kan selv de minste støv- eller røykpartiklene, fingeravtrykk etc. føre til uopprettelig skade på diskflatene og lese- / skrivehodene.

Huset er støvtett, men vanligvis ikke hermetisk forseglet ved luftfylte drev. En liten åpning som er utstyrt med et filter, tillater luft å komme inn eller ut ved lufttrykkssvingninger (for eksempel endringer i temperatur eller endringer i atmosfærisk lufttrykk ) for å kompensere for trykkforskjellene. Denne åpningen - se figuren ved siden av - må ikke lukkes. Siden lufttrykket i huset synker med økende høyde over havet , men et minimumstrykk er nødvendig for drift, kan disse harddiskene bare drives opp til et bestemt maksimal havnivå. Dette er vanligvis notert i det tilhørende databladet. Luften er nødvendig for å forhindre direkte kontakt mellom lese / skrivehodet og databærerens overflate ( hodekrasj ); se også avsnitt Les / skrive hovedenheten ovenfor. I nyere stasjoner brukes en elastisk membran i stedet for filteret, som systemet kan justere til endrede trykkforhold ved å bule i den ene eller den andre retningen.

Noen harddiskmodeller er fylt med helium, og i motsetning til de luftfylte stasjonene er de hermetisk forseglet. Sammenlignet med luft har helium lavere tetthet og høyere varmeledningsevne . Den lavere tettheten av helium resulterer i færre forstyrrende strømningseffekter, noe som fører til reduserte krefter som virker på motoren. Vibrasjoner forårsaket av posisjoneringen av støttearmene reduseres også. Som et resultat kan avstandene mellom de enkelte diskene reduseres, og flere av dem kan integreres med samme totale høyde, noe som fører til en høyere lagringstetthet for disse diskstasjonene. [16]

Installasjon

Fram til rundt 1990 -tallet måtte harddisker installeres i en definert posisjon, og som regel var bare horisontal drift (men ikke "overhead") eller vertikal posisjon ("på kanten") tillatt. Dies ist für heutige Laufwerke nicht mehr erforderlich und nicht mehr spezifiziert; sie können in jeder Lage betrieben werden. Alle Festplatten sind im Betrieb gegen Vibration empfindlich, da dadurch die Positionierung der Köpfe gestört werden kann. Wird eine Festplatte elastisch gelagert, ist dieser Punkt besonders zu berücksichtigen.

Speichern und Lesen von Bits

Die Scheibe mit der Magnetschicht, in der die Informationen gespeichert sind, rotiert an den Schreib-Lese-Köpfen (so) vorbei. Beim Lesen verursachen dabei Änderungen in der Magnetisierung der Oberfläche durch elektromagnetische Induktion einen Spannungsimpuls im Lesekopf. Bis zum Anfang des 21. Jahrhunderts wurde dabei fast ausschließlich die longitudinale Aufzeichnung verwendet, erst dann wurde auch die senkrechte Aufzeichnung eingeführt, die wesentlich höhere Schreibdichten erlaubt, aber kleinere Signale beim Lesen bewirkt, wodurch sie schwieriger zu beherrschen ist. Beim Schreiben dient derselbe Kopf zum Einschreiben der Information in die Magnetschicht. Zum Lesen sollte ein Magnetkopf anders ausgelegt sein als zum Schreiben, beispielsweise was die Breite des Magnetspalts betrifft; wird er für beides verwendet, müssen Kompromisse eingegangen werden, die die Leistung wieder begrenzen. Es gibt dazu neuere Ansätze durch spezielle Geometrien und Spulenwicklungen, diese Kompromisse effizienter zu gestalten.

Ein Leseimpuls entsteht also nur bei einer Änderung der Magnetisierung (mathematisch: Der Lesekopf „sieht“ sozusagen nur die Ableitung der Magnetisierung nach der Ortskoordinate). Diese Impulse bilden einen seriellen Datenstrom , der wie bei einer seriellen Schnittstelle von der Leseelektronik ausgewertet wird. Wenn beispielsweise Daten vorliegen, die zufällig über lange Strecken nur den logischen Pegel „0“ aufweisen, tritt solange keinerlei Änderung auf, also auch kein Signal am Lesekopf. Dann kann die Leseelektronik aus dem Takt kommen und falsche Werte lesen. Zur Abhilfe werden verschiedene Verfahren eingesetzt, die zusätzliche umgekehrt gepolte Bits in den Datenstrom einfügen, um eine zu lange Strecke einheitlicher Magnetisierung zu vermeiden. Beispiele dieser Verfahren sind MFM und RLL , die allgemeine Technik wird unter Leitungscode erläutert.

Beim Schreibvorgang wird je nach Logikpegel des Bits ein Strom unterschiedlicher Polung in die Magnetspule des Schreibkopfs gespeist (gegensätzliche Polung, jedoch gleiche Stärke). Der Strom bewirkt ein Magnetfeld, das Feld wird vom Magnetkern des Kopfs gebündelt und geführt. Im Spalt des Schreibkopfs treten die Magnetfeldlinien dann in die Oberfläche der Festplatte über und magnetisieren sie dabei in die gewünschte Richtung.

Speichern und Lesen von Byte-organisierten Daten

Heutige magnetische Festplatten organisieren ihre Daten – im Gegensatz zu Direktzugriffsspeichern (der sie in Bytes oder in kleinen Gruppen von 2 bis 8 Byte anordnet) – in Datenblöcken (wie z. B. 512, 2048 oder 4096 Byte), weshalb dieses Verfahren blockbasierte Adressierung genannt wird. Dabei können seitens der Schnittstelle immer nur ganze Datenblöcke oder Sektoren gelesen und geschrieben werden. (Bei früheren SCSI -Festplatten ermöglichte die Laufwerkselektronik einen byteweisen Zugriff.) [17]

Das Lesen von Blöcken erfolgt durch Angabe der linearen Sektornummer. Die Festplatte „weiß“, wo sich dieser Block befindet, und liest beziehungsweise schreibt ihn auf Anforderung.

Beim Schreiben von Blöcken:

- werden diese zuerst mit Fehlerkorrekturinformationen ( Vorwärtsfehlerkorrektur ) versehen,

- werden sie einer Modulation unterzogen: Früher waren GCR , MFM , RLL üblich, heutzutage haben PRML und neuerdings EPRML diese abgelöst, dann

- wird der Schreib-Lese-Kopf-Träger in die Nähe der Spur gefahren, die beschrieben werden soll,

- liest der Schreib-Lese-Kopf, welcher der informationtragenden Oberfläche zugeordnet ist, das Spursignal und führt die Feinpositionierung durch. Dazu gehört zum einen, die richtige Spur zu finden, zum anderen diese Spur auch genau mittig zu treffen.

- Ist der Schreiblesekopf stabil auf der Spur und befindet sich der richtige Sektor unter dem Schreiblesekopf, wird die Blockmodulation geschrieben.

- Bei vermuteter Fehlposition ist der Schreibvorgang sofort abzubrechen, damit keine Nachbarspuren (teilweise irreparabel) zerstört werden.

Beim Lesen werden diese Schritte umgekehrt ausgeführt:

- Schreib-Lese-Kopf-Träger in die Nähe der Spur fahren, die gelesen werden soll.

- der Schreib-Lese-Kopf, welcher der informationstragenden Oberfläche zugeordnet ist, liest das Spursignal und führt die Feinpositionierung durch.

- Nun wird die Spur so lange (oder etwas länger) gelesen, bis der gewünschte Sektor erfolgreich gefunden wurde.

- Bei diesem Vorgang gefundene Sektoren werden zuerst demoduliert und dann mittels der beim Schreiben erzeugten Vorwärtsfehlerkorrekturinformationen einer Fehlerkorrektur unterzogen.

- Üblicherweise werden meist weitaus mehr Sektoren als der angeforderte Sektor gelesen. Diese landen normalerweise im Festplattencache (wenn nicht schon vorhanden), da die Wahrscheinlichkeit groß ist, dass sie in Kürze noch benötigt werden.

- War ein Sektor schlecht lesbar (mehrere Leseversuche notwendig, Fehlerkorrektur zeigte etliche korrigierbare Fehler auf), wird er üblicherweise neu zugeordnet, dh an einer anderen Stelle gespeichert.

- War der Sektor nicht mehr lesbar, wird ein sogenannter CRC-Fehler gemeldet.

Logische Struktur der Scheiben

Die Magnetisierung der Beschichtung der Scheiben ist der eigentliche Informationsträger. Sie wird vom Schreib-Lese-Kopf auf kreisförmigen, konzentrischen Spuren erzeugt, während die Scheibe rotiert. Eine Scheibe enthält typischerweise einige tausend solcher Spuren, meist auf beiden Seiten. Die Gesamtheit aller gleichen, dh übereinander befindlichen Spuren der einzelnen Platten(oberflächen) nennt man Zylinder. Jede Spur ist in kleine logische Einheiten unterteilt, die man Blöcke nennt. Ein Block enthält traditionell 512 Byte an Nutzdaten. Jeder Block verfügt dabei über Kontrollinformationen ( Prüfsummen ), über die sichergestellt wird, dass die Information korrekt geschrieben oder gelesen wurde. Die Gesamtheit aller Blöcke, welche die gleichen Winkelkoordinaten auf den Platten haben, nannte man Sektor (bei MFM ). Der Aufbau eines speziellen Festplattentyps, dh die Anzahl der Zylinder (Spuren je Oberfläche), Köpfe (Oberflächen) und Sektoren, wird als Festplattengeometrie bezeichnet.

Bei der Einteilung in Sektoren steht für deren innere Blöcke nur wenig Magnetschicht-Fläche zur Verfügung, die jedoch zum Speichern eines Datenblocks ausreicht. Die äußeren Blöcke sind jedoch viel größer, und verbrauchen viel mehr Magnetschicht-Fläche als notwendig wäre. Seit RLL wird dieser Platz im Außenbereich nicht mehr verschwendet, die Daten werden dort ebenso dicht geschrieben wie im Innenbereich – eine Spur im Außenbereich beinhaltet nun mehr Blöcke als im Innenbereich, eine Sektoreinteilung ist daher nicht mehr möglich. Bei konstanter Rotationsgeschwindigkeit kann und muss die Festplattenelektronik im Außenbereich schneller lesen und schreiben als im Innenbereich. Durch diese Entwicklung verlor der Begriff Sektor seine ursprüngliche Wichtigkeit und wird heute vielfach (entgegen seiner eigentlichen Bedeutung) synonym für Block verwendet.

Da – als die Nummerierung der Blöcke bei steigenden Festplattenkapazitäten die Wortgrenze (16 Bit) überstieg – manche Betriebssysteme zu früh an Grenzen stießen, wurden Cluster eingeführt. Das sind Gruppen von jeweils einer festen Anzahl an Blöcken (z. B. 32), die sinnvollerweise physisch benachbart sind. Das Betriebssystem spricht dann nicht mehr einzelne Blöcke an, sondern verwendet auf seiner (höheren) Ebene als kleinste Zuordnungseinheit diese Cluster. Erst auf Hardwaretreiber-Ebene wird dieser Zusammenhang aufgelöst.

Bei modernen Festplatten ist normalerweise die wahre Geometrie , also die Anzahl an Sektoren, Köpfen und Zylindern , die vom Festplatten-Controller verwaltet werden, nach außen (dh für den Computer bzw. den Festplattentreiber) nicht sichtbar. Früher wurde dem Computer dann eine virtuelle Festplatte vorgespielt, die völlig andere Geometriedaten aufwies, um Begrenzungen der PC-kompatiblen Hardware zu überwinden. Zum Beispiel konnte eine Festplatte, die real nur vier Köpfe aufwies, vom Computer mit 255 Köpfen gesehen werden. Heute meldet eine Festplatte meist einfach die Anzahl ihrer Blöcke im LBA-Modus .

Heute übliche Festplatten teilen intern die Zylinder radial in Zonen ein, wobei die Zahl der Blöcke pro Spur innerhalb einer Zone gleich ist, beim Wechsel der Zone von innen nach außen aber zunimmt ( Zone Bit Recording ). Die innerste Zone hat die wenigsten Blöcke pro Spur, die äußerste Zone die meisten, weshalb die kontinuierliche Übertragungsrate beim Zonenwechsel von außen nach innen abnimmt.

Der Festplatten-Controller kann defekte Blöcke in die sogenannte Hot-Fix-Area ausblenden, um dann einen Block aus einem Reserve-Bereich einzublenden. Für den Computer scheint es dann immer so, als wären alle Blöcke defektfrei und nutzbar. Dieser Vorgang lässt sich jedoch per SMART über den Parameter Reallocated Sector Count nachvollziehen. Eine Festplatte, deren RSC-Wert in kurzer Zeit merklich ansteigt, wird in Kürze ausfallen.

Advanced Format

Festplattenmodelle verwenden seit 2010 zunehmend ein Sektorierungsschema mit größeren Sektoren mit fast ausschließlich 4096 Bytes („4K“). Die größeren Datenblöcke ermöglichen eine größere Redundanz und damit eine niedrigere Block-Fehlerrate (BER) und/oder geringeren Gesamtoverhead im Verhältnis zur Nutzdatenmenge. [18] [19] [20] Um nach einer jahrzehntelangen, (fast) ausschließlichen Verwendung von Blöcken mit 512 Byte Kompatibilitätsprobleme zu vermeiden, emulieren die meisten Laufwerke an ihrer Schnittstelle eine Blockgröße von 512 Byte („512e“). Ein physischer Block von 4096 Byte wird als acht logische Blöcke von 512 Byte emuliert – die Laufwerks firmware nimmt die zusätzlich notwendigen Schreib- und Leseoperationen dann selbstständig vor. Dadurch wird grundsätzlich eine Verwendung mit bestehenden Betriebssystemen und Treibern sichergestellt.

Die 512e-Emulation stellt sicher, dass Advanced-Format-Laufwerke mit vorhandenen Betriebssystemen kompatibel sind – es kann zu Leistungseinbußen kommen, wenn physische Blöcke nur teilweise beschrieben werden sollen (die Firmware muss dann den physischen Block lesen, verändern und wieder zurückschreiben). Solange die Organisationseinheiten ( Cluster ) des Dateisystems sich mit den physischen Sektoren genau decken, ist dies kein Problem, wohl aber, wenn die Strukturen zueinander versetzt sind. Bei aktuellen Linux -Versionen, bei Windows ab Vista SP1 und macOS ab Snow Leopard werden neue Partitionen so angelegt, wie es für Advanced-Format-Laufwerke sinnvoll ist; beim bis nach Supportende 2014 noch relativ weit verbreiteten Windows XP jedoch nicht. So lassen sich bei Windows XP auf „4K“ ausgerichtete Partitionen mit verschiedenen Zusatztools anlegen; in der Regel werden solche Programme vom Laufwerkshersteller zur Verfügung gestellt.

Obwohl durch 48-Bit- LBA Festplatten bis zu 128 PiB unter Verwendung von 512-Byte-Sektoren angesprochen werden können, gibt es bei Verwendung des MBR als Partitionstabelle bereits bei Festplatten mit mehr als 2 TiB Einschränkungen. Auf Grund seiner nur 32 Bit großen Felder ist die maximale Partitionsgröße auf 2 TiB beschränkt (2 32 = 4.294.967.296 Sektoren bei einer Block-/Sektorgröße von 512 Byte); ferner muss ihr erster Block in den ersten 2 TiB liegen, was somit die maximal verwendbare Festplattengröße auf 4 TiB beschränkt. Für die uneingeschränkte Nutzung von Festplatten > 2 TiB ist ein Betriebssystem nötig, welches die GPT unterstützt. Das Booten von Festplatten mit GPT unterliegt je nach Betriebssystem und Firmware (BIOS, EFI, EFI+CSM) weiteren Einschränkungen.

Eine Emulation ist zunehmend nicht mehr notwendig („4K native“ bzw. „4Kn“). Beispielsweise unterliegen externe Festplatten (wie z. B. die Elements-Baureihe von Western Digital) keinen Einschränkungen durch eventuell inkompatible Laufwerkscontroller. Aufgrund der nativen Adressierung können diese Platten auch mit einer MBR-Partitionstabelle jenseits der 4-TiB-Grenze verwendet werden. Das Booten von solchen Datenträgern wird von Windows ab Windows 8 /Windows Server 2012 [21] unterstützt.

Geschwindigkeit

Die Festplatte gehört mit zu den langsamsten Teilen eines PC-Kernsystems. Deshalb sind die Geschwindigkeiten einzelner Festplattenfunktionen von besonderer Bedeutung. Die wichtigsten technischen Parameter sind die kontinuierliche Übertragungsrate (sustained data rate) und die mittlere Zugriffszeit (data access time) . Die Werte kann man den Datenblättern der Hersteller entnehmen.

Die kontinuierliche Übertragungsrate ist jene Datenmenge pro Sekunde, welche die Festplatte beim Lesen aufeinander folgender Blöcke im Mittel überträgt. Die Werte beim Schreiben sind meist ähnlich und werden deshalb üblicherweise nicht angegeben. Bei früheren Festplatten benötigte die Laufwerkselektronik mehr Zeit zur Verarbeitung eines Blocks als die reine Hardware-Lesezeit. Daher wurden „logisch aufeinanderfolgende“ Blöcke nicht physisch aufeinanderfolgend auf dem Platter gespeichert, sondern mit einem oder zwei Blöcken Versatz. Um alle Blocks einer Spur „aufeinanderfolgend“ zu lesen, musste der Platter folglich zwei oder drei Mal rotieren ( Interleave-Faktor 2 oder 3). Heutige Festplatten besitzen ausreichend schnelle Elektronik und speichern logisch aufeinanderfolgende Blöcke auch physisch aufeinanderfolgend.

Sowohl beim Schreiben als auch beim Lesen muss vor dem Zugriff auf einen bestimmten Block der Schreib-Lese-Kopf der Platte zur gewünschten Spur bewegt und anschließend abgewartet werden, bis durch die Rotation der Platte der richtige Block unter dem Kopf vorbeigeführt wird. Diese mechanisch bedingten Verzögerungen liegen Stand 2009 bei etwa 6–20 ms, was nach Maßstäben anderer Computerhardware eine kleine Ewigkeit ist. Daraus ergibt sich die extrem hohe Latenzzeit von Festplatten im Vergleich zu RAM , die noch auf der Ebene der Softwareentwicklung und der Algorithmik berücksichtigt werden muss.

Die Zugriffszeit setzt sich aus mehreren Anteilen zusammen:

- der Spurwechselzeit (seek time) ,

- der Latenzzeit (latency) und

- die Kommando-Latenz (controller overhead) .

Die Spurwechselzeit wird von der Stärke des Antriebs für den Schreib-Lese-Kopf (Servo) bestimmt. Abhängig davon, welche Strecke der Kopf zurücklegen muss, ergeben sich unterschiedliche Zeiten. Angegeben wird normalerweise nur der Mittelwert beim Wechsel von einer zufälligen zu einer anderen zufälligen Spur (gewichtet nach der Zahl der Blöcke auf den Spuren).

Die Latenzzeit ist eine unmittelbare Folge der Umdrehungsgeschwindigkeit. Im Mittel dauert es eine halbe Umdrehung, bis ein bestimmter Sektor unter dem Kopf vorbeikommt. Daraus ergibt sich der feste Zusammenhang:

bzw. als zugeschnitte Größengleichung für die Latenzzeit in Millisekunden und die Drehzahl pro Minute:

Die Kommandolatenz ist die Zeit, die der Festplattencontroller damit verbringt, das Kommando zu interpretieren und die erforderlichen Aktionen zu koordinieren. Diese Zeit ist heutzutage vernachlässigbar.

Die Aussagekraft dieser technischen Parameter für die Systemgeschwindigkeit ist begrenzt. Deshalb wird im professionellen Bereich eine andere Kennzahl, nämlich Input/Output operations Per Second (IOPS) verwendet. Diese wird bei kleinen Blockgrößen hauptsächlich von der Zugriffszeit dominiert. Aus der Definition wird klar, dass zwei halb so große Platten gleicher Geschwindigkeit dieselbe Datenmenge mit der doppelten IOPS-Zahl bereitstellen.

| Kategorie | Jahr | Modell | Größe | Drehzahl | Datenrate | Spur- wechsel |

Latenz | Mittlere Zugriffszeit |

|---|---|---|---|---|---|---|---|---|

| GB | min −1 | MB/s | ms | |||||

| Server | 1993 | IBM 0662 | 1 | 5.400 | 5 | 8,5 | 5,6 | 15,4 |

| Server | 2002 | Seagate Cheetah X15 36LP |

18 – 36 |

15.000 |

52 – 68 |

3,6 | 2,0 | 5,8 |

| Server | 2007 | Seagate Cheetah 15k.6 |

146 – 450 |

15.000 |

112 –171 |

3,4 | 2,0 | 5,6 |

| Server | 2017 | Seagate Exos E 2,5″ |

300 – 900 |

15.000 |

210 –315 |

2,0 | ||

| Desktop | 1989 | Seagate ST296N | 0,080 | 3.600 | 0,5 | 28 | 8,3 | 40 |

| Desktop | 1993 | Seagate Marathon 235 |

0,064 – 0,210 |

3.450 | 16 | 8,7 | 24 | |

| Desktop | 1998 | Seagate Medalist 2510–10240 |

2,5 – 10 |

5.400 | 10,5 | 5,6 | 16,3 | |

| Desktop | 2000 | IBM Deskstar 75GXP |

20 – 40 |

5.400 | 32 | 9,s | 5,6 | 15,3 |

| Desktop | 2009 | Seagate Barracuda 7200.12 |

160 –1.000 |

7.200 | 125 | 8,5 | 4,2 | 12,9 |

| Desktop | 2019 | Western Digital Black WD6003FZBX | 6.000 | 7.200 | 201 | 4,2 | 14,4 | |

| Notebook | 1998 | Hitachi DK238A |

3,2 – 4,3 |

4.200 |

8,7 – 13,5 |

12 | 7,1 | 19,3 |

| Notebook | 2008 | Seagate Momentus 5400.6 |

120 – 500 |

5.400 |

39 – 83 |

14 | 5,6 | 18 |

Die Entwicklung der Festplattenzugriffszeit kann mit der anderer PC-Komponenten wie CPU , RAM oder Grafikkarte nicht mehr Schritt halten, weshalb sie zum Flaschenhals geworden ist. Um eine hohe Leistung zu erreichen, muss eine Festplatte deshalb, soweit möglich, immer große Mengen von Daten in aufeinander folgenden Blöcken lesen oder schreiben, weil dabei der Schreib-Lese-Kopf nicht neu positioniert werden muss.

Das wird unter anderem dadurch erreicht, dass möglichst viele Operationen im RAM durchgeführt und auf der Platte die Positionierung der Daten auf die Zugriffsmuster abgestimmt werden. Dazu dient vor allem ein großer Cache im Arbeitsspeicher des Computers, der von allen modernen Betriebssystemen zur Verfügung gestellt wird. Zusätzlich hat die Festplattenelektronik einen Cache (Stand 2012 für Platten von 1 bis 2 TB zumeist 32 oder 64 MiB), der vor allem zur Entkopplung der Interface-Transferrate von der unveränderlichen Transferrate des Schreib-Lese-Kopfes dient.

Neben der Verwendung eines Caches gibt es weitere Software-Strategien zur Performance-Steigerung. Sie werden vor allem in Multitasking -Systemen wirksam, wo das Festplattensystem mit mehreren beziehungsweise vielen Lese- und Schreibanforderungen gleichzeitig konfrontiert wird. Es ist dann meist effizienter, diese Anforderungen in eine sinnvolle neue Reihenfolge zu bringen. Die Steuerung erfolgt durch einen Festplatten-Scheduler , häufig in Verbindung mit Native Command Queuing (NCQ) oder Tagged Command Queuing (TCQ). Das einfachste Prinzip verfolgt dabei dieselbe Strategie wie eine Aufzugssteuerung: Die Spuren werden zunächst in einer Richtung angefahren und die Anforderungen beispielsweise nach monoton steigenden Spurnummern abgearbeitet. Erst wenn diese alle abgearbeitet sind, kehrt die Bewegung um und arbeitet dann in Richtung monoton fallender Spurnummern usw.

Bis etwa 1990 besaßen Festplatten meist so wenig Cache (0,5 bis maximal 8 KiB ), dass sie keine komplette Spur (damals 8,5 KiB oder 13 KiB) zwischenspeichern konnten. Daher musste der Datenzugriff durch Interleaving gebremst beziehungsweise optimiert werden. Nicht notwendig war dies bei Platten mit hochwertigem SCSI- oder ESDI-Controller beziehungsweise bei den damals aufkommenden IDE-Platten.

Die seit etwa 2008 verwendeten SSD („ Solid-State Disks“; sie arbeiten mit Halbleitertechnik, einem Teilgebiet der Festkörperphysik (engl. Solid-state physics )) weisen prinzipbedingt wesentlich kürzere Zugriffszeiten auf. Seit 2011 gibt es auch kombinierte Laufwerke, die – für den Computer transparent – einen Teil der Kapazität als SSD realisieren, die als Puffer der konventionellen Platte dient.

Partitionen

Aus Sicht des Betriebssystems können Festplatten durch Partitionierung in mehrere Bereiche unterteilt werden. Das sind keine echten Laufwerke, sondern sie werden nur vom Betriebssystem als solche dargestellt. Man kann sie sich als virtuelle Festplatten vorstellen, die durch den Festplattentreiber dem Betriebssystem gegenüber als getrennte Geräte dargestellt werden. Die Festplatte selbst „kennt“ diese Partitionen nicht, es ist eine Sache des übergeordneten Betriebssystems.

Jede Partition wird vom Betriebssystem gewöhnlich mit einem Dateisystem formatiert. Unter Umständen werden, je nach benutztem Dateisystem, mehrere Blöcke zu Clustern zusammengefasst, die dann die kleinste logische Einheit für Daten sind, die auf die Platte geschrieben werden. Das Dateisystem sorgt dafür, dass Daten in Form von Dateien auf die Platte abgelegt werden können. Ein Inhaltsverzeichnis im Dateisystem sorgt dafür, dass Dateien wiedergefunden werden und hierarchisch organisiert abgelegt werden können. Der Dateisystem-Treiber verwaltet die belegten, verfügbaren und defekten Cluster. Bekannte Beispiele für Dateisysteme sind FAT , NTFS (Windows), HFS Plus (Mac OS) und ext4 (Linux).

Verbünde

Sollen größere Datenmengen oder große Datenmengen statt auf einer einzelnen großen, teuren Platte auf günstigeren, kleinen und langzeiterprobten Platten gespeichert werden, kann man sie mit einem Logical Volume Manager als JBOD zusammenfassen oder mit RAIDs zusätzlich gegen Ausfälle vorbeugen und sie in Disk-Arrays zusammenfassen. Dies kann in einem Server oder einem Network Attached Storage geschehen, welcher von mehreren genutzt werden kann, oder man baut überhaupt ein eigenes Storage Area Network auf. Man kann auch (meist externes) Cloud-Computing nutzen, welches die bisher angesprochenen Techniken nutzt.

Geräuschvermeidung

Um die Lautstärke der Laufwerke beim Zugriff auf Daten zu verringern, unterstützen die meisten für den Desktop-Einsatz gedachten ATA- und SATA-Festplatten seit circa 2003 Automatic Acoustic Management (AAM), das heißt, sie bieten die Möglichkeit, per Konfiguration die Zugriffszeit zugunsten geringerer Geräuschentwicklung zu verlängern. Wird die Festplatte in einem leisen Modus betrieben, werden die Schreib/Leseköpfe weniger stark beschleunigt, so dass die Zugriffe leiser sind. Das Laufgeräusch des Plattenstapels sowie die Daten-Transferrate werden davon nicht verändert, jedoch verlängert sich die Zugriffszeit. Dem gleichen Zweck dienen als „Entkopplung“ oder „Entkoppler“ bezeichnete Aufhängungen mit elastischen Elementen, die eine Übertragung der Vibrationen der Festplatte auf Gehäusebauteile verhindern sollen.

Schnittstellen, Bussystem und Jumper

Ursprünglich (bis 1990/91) befand sich das, was heute als Schnittstelle zur Festplatte verstanden wird, bei Consumer-Platten nicht auf der Festplatte. Dafür war ein Controller in Form einer ISA-Steckkarte notwendig. Dieser Controller sprach die Platte unter anderem über eine ST506-Schnittstelle an (mit den Modulationsstandards MFM , RLL oder ARLL ). Die Kapazität der Platte war mit vom Controller abhängig, gleiches galt für die Datenzuverlässigkeit. Eine 20-MB-MFM-Platte konnte an einem RLL-Controller 30 MB speichern, aber ggf. mit einer höheren Fehlerrate .

Bedingt durch die Trennung von Controller und Medium musste letzteres vor dem Gebrauch low-level- formatiert werden (Sektorierung). Im Gegensatz zu diesen früheren Festplatten mit Schrittmotoren sind modernere Festplatten mit Linearmotoren ausgestattet, die eine Sektorierung und vor allem das Schreiben der Servoinformationen während der Herstellung erforderlich machen und ansonsten nicht mehr low-level-formatiert werden können.

Mit ESDI wurde ein Teil des Controllers ins Laufwerk integriert, um Geschwindigkeit und Zuverlässigkeit zu steigern. Mit SCSI - und IDE-Platten endete dann die Trennung von Controller und Speichergerät. Sie setzen statt der früheren Controller Host-Bus-Adapter ein, die eine wesentlich universellere Schnittstelle zur Verfügung stellen. HBAs existieren als eigene Steckkarten als auch auf Hauptplatinen oder in Chipsätze integriert und werden häufig immer noch als „Controller“ bezeichnet.

Als Schnittstellen für interne Festplatten werden im Desktop-Bereich heute fast ausschließlich Serial-ATA -Schnittstellen eingesetzt. Bis vor einigen Jahren war hier noch parallele ATA- (oder IDE, EIDE) -Schnittstellen üblich. Allerdings ist die IDE-Schnittstelle in Spielkonsolen und Festplattenrekordern weiterhin weit verbreitet.

Bei Servern und Workstations hat sich neben SATA im Wesentlichen SAS und Fibre-Channel etabliert. Die Mainboards waren lange Zeit mit meist zwei ATA-Schnittstellen versehen (für max. 4 Laufwerke), inzwischen wurden diese annähernd vollständig durch (bis zu 10) SATA -Schnittstellen ersetzt.

Ein prinzipielles Problem bei parallelen Übertragungen ist, dass es mit zunehmender Geschwindigkeit immer schwieriger wird, unterschiedliche Laufzeiten der einzelnen Bits durch das Kabel sowie Übersprechen zu beherrschen. Daher stießen die parallelen Schnittstellen mehr und mehr an ihre Grenzen. Serielle Leitungen, insbesondere in Verbindung mit differentiellen Leitungspaaren erlauben inzwischen deutlich höhere Übertragungsraten.

ATA (IDE)

Bei einer ATA -Festplatte wird durch Jumper festgelegt, ob sie das Laufwerk mit Adresse 0 oder 1 der ATA-Schnittstelle ist (Device 0 beziehungsweise 1, oft mit Master beziehungsweise Slave bezeichnet). Manche Modelle erlauben eine Beschränkung der an das Betriebssystem beziehungsweise BIOS gemeldeten Kapazität des Laufwerks, wodurch die Festplatte im Falle von Inkompatibilitäten dennoch in Betrieb genommen werden kann; allerdings wird dabei der nicht gemeldete Plattenplatz verschenkt.

Durch die Festlegung der ATA-Bus-Adresse können zwei Festplatten an einer ATA-Schnittstelle des Mainboards angeschlossen werden. Die meisten Mainboards haben zwei ATA-Schnittstellen, genannt primary ATA und secondary ATA , also „erste“ und „zweite ATA-Schnittstelle“. Daher können insgesamt bis zu vier Festplatten an beide ATA-Schnittstellen der Hauptplatine angeschlossen werden. Ältere BIOS von Hauptplatinen erlauben es nur, den Computer von der ersten ATA-Schnittstelle zu starten, und auch nur, wenn die Festplatte als Master gejumpert ist.

Die ATA-Schnittstellen werden jedoch nicht nur von Festplatten, sondern auch von CD-ROM- und DVD-Laufwerken genutzt. Somit ist (ohne Zusatzkarte) die Gesamtzahl von Festplatten plus ladbaren Laufwerken (CD-ROM, DVD) auf vier begrenzt ( Diskettenlaufwerke haben eine andere Schnittstelle). CompactFlash -Karten können per Adapter angeschlossen und wie eine Festplatte verwendet werden.

Bei Erweiterungen sind einige Dinge zu beachten:

- Das erste Laufwerk ist als „Master“ zu jumpern – in der Regel die Voreinstellung von Laufwerken; erst ein eventuell zweites Laufwerk an einem Kabel wird auf „Slave“ gejumpert. Einige Laufwerke haben noch die dritte Option „Single Drive“. Diese wird dann benutzt, wenn das Laufwerk alleine am Kabel hängt; kommt ein „Slave“-Laufwerk dazu, muss man das erste als „Master“ jumpern. Diese Option heißt dann zur Erläuterung oftmals „Master with Slave present“.

- Wo Master oder Slave sitzen (am Ende des Kabels oder „mittendrin“), spielt keine Rolle (außer, beide Laufwerke sind auf Cable Select gejumpert). „Slave allein“ funktioniert zwar meistens, gilt aber nicht als sauber konfiguriert und ist oft störanfällig. Ausnahme: Bei den neueren 80-poligen Kabeln sollte der Slave in der Mitte angeschlossen werden; die Stecker sind dementsprechend beschriftet.

Die ideale Verteilung der Laufwerke auf die einzelnen Anschlüsse ist disputabel. Zu beachten ist, dass sich traditionell zwei Geräte am selben Kabel die Geschwindigkeit teilen und dass das langsamere Gerät den Bus länger belegt und somit das schnellere bremsen kann. Bei der gängigen Konfiguration mit einer Festplatte und einem CD/DVD-Laufwerk ist es daher von Vorteil, jedes dieser beiden Geräte mit einem eigenen Kabel zu einer Schnittstelle auf der Hauptplatine zu verwenden. Neben den Jumpern existiert ein automatischer Modus für die Bestimmung der Adressen („Cable-Select“), der jedoch geeignete Anschlusskabel erfordert, die früher wenig verbreitet waren, aber seit ATA-5 (80-polige Kabel) Standard sind.

ESDI

Parallel SCSI

Die Adresse von Parallel-SCSI-Festplatten kann nicht wie IDE-Festplatten nur zwischen zwei, sondern je nach verwendetem Controller zwischen 7 bzw. 15 Adressen ausgewählt werden. Dafür befinden sich an älteren SCSI-Laufwerken drei bzw. vier Jumper zur Festlegung der Adresse – SCSI-ID-Nummer genannt –, die es erlauben, bis 7 bzw. 15 Geräte pro SCSI-Bus einzeln zu adressieren. Die Anzahl der maximal möglichen Geräte ergibt sich aus der Anzahl der ID-Bits (drei bei SCSI bzw. vier bei Wide-SCSI) unter Berücksichtigung der vom Controller selbst belegten Adresse #0. Neben Jumpern fand man selten die Adresseinstellung auch durch einen kleinen Drehschalter . Bei modernen Systemen werden die IDs automatisch vergeben (nach der Reihenfolge am Kabel), und die Jumper sind nur noch relevant, wenn diese Vergabe beeinflusst werden soll.

Dazu kommen noch andere Jumper wie der (optionale) Schreibschutzjumper, der es erlaubt, eine Festplatte gegen Beschreiben zu sperren. Weiterhin können je nach Modell Einschaltverzögerungen oder das Startverhalten beeinflusst werden.

SATA

Seit 2002 werden Festplatten mit Serial ATA (S-ATA oder SATA)-Schnittstelle angeboten. Die Vorteile gegenüber ATA sind der höhere mögliche Datendurchsatz und die vereinfachte Kabelführung. Erweiterte Versionen von SATA verfügen über weitere, vor allem für professionelle Anwendungen relevante, Funktionen, wie etwa die Fähigkeit zum Austausch von Datenträgern im laufenden Betrieb ( Hot-Plug ). Inzwischen hat sich SATA praktisch durchgesetzt, die neuesten Festplatten werden nicht mehr als IDE-Versionen angeboten, seit die bei IDE theoretisch möglichen Transferraten nahezu erreicht sind.

Im Jahr 2005 wurden erste Festplatten mit Serial Attached SCSI (SAS) als potentieller Nachfolger von SCSI für den Server- und Storagebereich vorgestellt. Dieser Standard ist teilweise zu SATA abwärtskompatibel.

Serial Attached SCSI (SAS)

Die SAS -Technik basiert auf der etablierten SCSI-Technik, sendet die Daten jedoch seriell und verbindet die Geräte nicht über einen gemeinsamen Bus, sondern einzeln über dedizierte Ports (oder Port Multiplier). Neben der höheren Geschwindigkeit im Vergleich zu herkömmlicher SCSI-Technik können theoretisch über 16.000 Geräte in einem Verbund angesprochen werden. Ein weiterer Vorteil ist die maximale Kabellänge von 10 Metern. Die Steckverbindungen von SATA sind zu SAS kompatibel, ebenso SATA-Festplatten; SAS-Festplatten benötigen jedoch einen SAS-Controller.

Fibre-Channel-Interface

Die Kommunikation via Fibre-Channel -Interface ist noch leistungsfähiger und ursprünglich vor allem für die Verwendung in Speichersubsystemen entwickelt. Die Festplatten werden, wie bei USB, nicht direkt angesprochen, sondern über einen FC-Controller, FC-HUBs oder FC-Switches.

Queuing im SCSI-, SATA oder SAS-Datentransfer

Vor allem bei SCSI-Platten und bei neueren SATA-Festplatten werden sogenannte Queues (Warteschlangen) eingesetzt. Das sind Software-Verfahren als Teil der Firmware , die die Daten zwischen dem Anfordern von Computerseite und physikalischem Zugriff auf die Speicherscheibe verwalten und ggf. zwischenspeichern. Beim Queuing reihen sie die Anfragen an den Datenträger in eine Liste und sortieren sie entsprechend der physikalischen Position auf der Scheibe und der aktuellen Position der Schreibköpfe, um so möglichst viele Daten mit möglichst wenigen Umdrehungen und Kopfpositionierungen zu lesen. Der festplatteneigene Cache spielt hier eine große Rolle, da die Queues in diesem abgelegt werden (siehe auch: Tagged Command Queuing , Native Command Queuing ).

Vorläufer der seriellen High-Speed-Schnittstellen

Die ersten verbreiteten seriellen Schnittstellen für Festplatten waren SSA ( Serial Storage Architecture , von IBM entwickelt) und Fibre Channel in der Variante FC-AL (Fibre Channel-Arbitrated Loop). SSA-Festplatten werden heute praktisch nicht mehr hergestellt, aber Fibre-Channel-Festplatten werden weiterhin für den Einsatz in großen Speichersystemen gebaut. Fibre Channel bezeichnet dabei das verwendete Protokoll, nicht das Übertragungsmedium. Deshalb haben diese Festplatten trotz ihres Namens keine optische, sondern eine elektrische Schnittstelle.

Externe Festplatten

Externe Festplatten gibt es als lokale Massenspeicher (Block-Geräte) oder als Netzwerk-Massenspeicher ( NAS ). Im ersten Fall ist die Festplatte über Hardware-Schnittstellen-Adapter als lokales Laufwerk angeschlossen; in zweiten Fall ist das Laufwerk eine Remote-Ressource, die das NAS (ein über ein Netzwerk angebundener Computer) anbietet.

Für den Anschluss von externen Festplatten werden universelle Schnittstellen wie FireWire , USB oder eSATA verwendet. Zwischen der Festplatte und der Schnittstelle befindet sich hierzu eine Bridge , die an einer Seite einen PATA- oder SATA-Anschluss besitzt zum Anschluss der eigentlichen Festplatte, und an der anderen Seite einen USB-, Firewire-, eSATA-Anschluss oder mehrere dieser Anschlüsse zum Anschluss an den Computer. Bei derartigen externen Festplatten sind teilweise zwei Festplatten in einem Gehäuse verbaut, die gegenüber dem Computer jedoch nur als ein Laufwerk auftreten ( RAID -System).

Bei NAS-Systemen ist ein Netzwerkanschluss vorhanden.

Datenschutz und Datensicherheit

Besonders für Behörden und Unternehmen sind Datenschutz und Datensicherheit äußerst sensible Themen. Vor allem im Bereich der externen Festplatten, die als mobile Datenspeicher eingesetzt werden, müssen Behörden und Unternehmen Sicherheitsstandards anwenden. Gelangen sensible Daten in unbefugte Hände, entsteht meist ein irreparabler Schaden. Um dies zu verhindern und höchste Datensicherheit für den mobilen Datentransport zu gewährleisten, müssen folgende Hauptkriterien beachtet werden:

- Verschlüsselung ,

- Zugriffskontrolle und die

- Verwaltung des kryptographischen Schlüssels.

Verschlüsselung

Daten können seitens des Betriebssystems verschlüsselt werden oder direkt durch das Laufwerk ( Microsoft eDrive , Self-Encrypting Drive ). Typische Speicherorte des Kryptoschlüssels sind USB-Stick oder Smartcard. Bei Speicherung innerhalb des Computersystems (auf der Festplatte, im Plattencontroller, in einem Trusted Platform Module ) wird der eigentliche Zugriffsschlüssel erst durch Kombination mit einem einzugebenden Passwort o. ä. (Passphrase) generiert.

Schadprogramme (Viren) können dem Benutzer durch Verschlüsselung bzw. Setzen des Hardware-Passworts auf einen unbekannten Wert massiv schaden. Es besteht dann für den Benutzer keine Möglichkeit mehr, auf den Inhalt der Festplatte zuzugreifen, ohne das Passwort zu kennen – für dessen (vermeintliche) Übermittlung wird meist Lösegeld gefordert ( Ransomware ).

Zugriffskontrolle

Verschiedene Festplatten bieten die Möglichkeit an, den kompletten Festplatteninhalt per Passwort direkt auf Hardwareebene zu schützen. Diese im Grunde nützliche Eigenschaft ist jedoch kaum bekannt. Für den Zugriff auf eine Festplatte kann ein ATA-Passwort vergeben werden.

Ausfallursachen und Lebensdauer

Zu den typischen Ausfallursachen gehören:

- Die Anfälligkeit von Festplatten ist besonders bei den neuen, sehr schnell drehenden Systemen vorwiegend auf thermische Probleme zurückzuführen.

- Beim mechanischen Aufsetzen des Schreib-Lese-Kopfes kann die Festplatte beschädigt werden ( Head-Crash ). Der Kopf schwebt im Betrieb auf einem Luftpolster über der Platte und wird nur durch dieses Polster daran gehindert, aufzusetzen. Im laufenden Betrieb sollte die Festplatte daher möglichst nicht bewegt werden und keinen Erschütterungen ausgesetzt sein.

- Äußere Magnetfelder können die Sektorierung der Festplatte beeinträchtigen und sogar zerstören. [22]

- Fehler in der Steuerelektronik oder Verschleiß der Mechanik führen zu Ausfällen.

- Umgekehrt kann auch längerer Stillstand dazu führen, dass die Mechanik in Schmierstoffen stecken bleibt und die Platte gar nicht erst anläuft („ sticky disk “).

Die durchschnittliche Zahl an Betriebsstunden, bevor eine Festplatte ausfällt, wird bei irreparablen Platten als MTTF (Mean Time To Failure) bezeichnet. Bei Festplatten, die repariert werden können, wird ein MTBF -Wert (Mean Time Between Failures) angegeben. Alle Angaben zur Haltbarkeit sind ausschließlich statistische Werte. Die Lebensdauer einer Festplatte kann daher nicht im Einzelfall vorhergesagt werden, denn sie hängt von vielen Faktoren ab:

- Vibrationen und Stöße: Starke Erschütterungen können zu einem vorzeitigen (Lager-)Verschleiß führen und sollten daher vermieden werden.

- Unterschiede zwischen verschiedenen Modellreihen eines Herstellers: Abhängig vom jeweiligen Modell lassen sich bestimmte Baureihen ausmachen, die als besonders zuverlässig oder fehleranfällig gelten. Um statistisch genau Angaben zu der Zuverlässigkeit machen zu können, sind eine große Anzahl von baugleichen Platten notwendig, die unter ähnlichen Bedingungen betrieben werden. Systemadministratoren, die viele Systeme betreuen, können so im Laufe der Jahre durchaus einige Erfahrungen sammeln, welche Festplatten eher zu auffälligem Verhalten und damit vorzeitigem Ausfall neigen.

- Anzahl der Zugriffe (Lesekopfbewegungen): Durch häufige Zugriffe verschleißt die Mechanik schneller, als wenn die Platte nicht genutzt wird und sich nur der Plattenstapel dreht. Dieser Einfluss ist jedoch nur gering. [23]

- Wenn die Festplatte über der vom Hersteller genannten Betriebstemperatur, meist 40–55 °C, betrieben wird, leidet die Lebensdauer. Nach einer Studie des Unternehmens Google Inc. (welches interne Festplattenausfälle analysierte) gibt es am oberen Ende des zulässigen Bereiches keine vermehrten Ausfälle. [23]

Allgemein sind schnelldrehende Server-Festplatten für eine höhere MTTF ausgelegt als typische Desktop-Festplatten, so dass sie theoretisch eine höhere Lebensdauer erwarten lassen. Dauerbetrieb und häufige Zugriffe können jedoch dazu führen, dass sich das relativiert und die Festplatten nach wenigen Jahren ausgetauscht werden müssen.

Notebook-Festplatten werden durch die häufigen Transporte besonders beansprucht und sind dementsprechend trotz robusterer Bauart mit einer kleineren MTTF als Desktop-Festplatten spezifiziert.

Eine genaue Haltbarkeit der gespeicherten Daten wird von den Herstellern nicht angegeben. Lediglich magneto-optische Verfahren erreichen eine Persistenz von 50 Jahren und mehr.

Vorbeugende Maßnahmen gegen Datenverlust

Als vorbeugende Maßnahmen gegen Datenverlust werden daher häufig folgende Maßnahmen ergriffen:

- Von wichtigen Daten sollte immer eine Sicherungskopie (Backup) auf einem anderen Datenträger (beachte den Hinweis zum Ausfall oben unter Partitionierung ) existieren.

- Systeme, die zwingend hochverfügbar sein müssen und bei denen ein Festplattenfehler keine Betriebsunterbrechung und Datenverlust verursachen darf, verfügen meistens über RAID . Eine Konfiguration ist zum Beispiel das Mirrorset ( RAID 1 ), bei dem die Daten auf zwei Festplatten gespiegelt werden und sich somit die Ausfallsicherheit erhöht. Effizientere Konfigurationen sind RAID 5 und höher. Ein Stripeset ( RAID 0 ) aus zwei Festplatten erhöht zwar die Geschwindigkeit, jedoch steigt das Ausfallrisiko. RAID 0 ist deshalb keine Maßnahme, um Datenverlust zu verhindern oder die Verfügbarkeit des Systems zu erhöhen.

- ATA-Festplatten verfügen seit circa Ende der 1990er-Jahre über SMART , eine interne Überwachung der Festplatte auf Zuverlässigkeit. Der Status kann von außen abgefragt werden. Ein Nachteil ist, dass SMART kein Standard ist. Jeder Hersteller definiert seine Fehlertoleranz selbst, dh SMART ist nur als allgemeines Richtmittel anzusehen. Außerdem gibt es Festplatten, deren SMART-Funktion selbst dann noch nicht vor Problemen warnt, wenn diese sich bereits im Betrieb durch nicht mehr lesbare Blöcke bemerkbar gemacht haben.

- Die meisten Festplatten können in beliebiger Lage montiert werden, im Zweifelsfall sollte die Spezifikation des Herstellers beachtet werden. Des Weiteren ist die Festplatte fest zu verschrauben, um Eigenschwingung zu unterbinden.

- Während des Einbaus sollten Maßnahmen zum Schutz vor ESD getroffen werden.

Zuverlässiges Löschen

Unabhängig vom verwendeten Speichermedium (in diesem Fall eine Festplatte) wird beim Löschen einer Datei zumeist lediglich im Dateisystem vermerkt, dass der entsprechende Datenbereich nun frei ist. Die Daten selbst verbleiben jedoch physisch auf der Festplatte, bis der entsprechende Bereich mit neuen Daten überschrieben wird. Mit Datenrettungsprogrammen können gelöschte Daten daher oft zumindest zum Teil wiederhergestellt werden. Das wird häufig in der Beweissicherung zum Beispiel bei den Ermittlungsbehörden (Polizei usw.) eingesetzt.

Beim Partitionieren oder (Schnell-) Formatieren wird der Datenbereich nicht überschrieben, sondern lediglich die Partitionstabelle oder die Beschreibungsstruktur des Dateisystems. Formatierungstools bieten im Allgemeinen zusätzlich an, den Datenträger komplett zu überschreiben.

Um ein sicheres Löschen von sensiblen Daten zu garantieren, bieten verschiedene Hersteller Software an, sogenannte Eraser , die beim Löschen den Datenbereich mehrfach überschreiben kann. Bereits das einmalige Überschreiben hinterlässt jedoch keine verwertbaren Informationen. [24] Alternativ kann auf eine der zahlreichen, direkt von CD startbaren kostenlosen Unix -Distributionen zurückgegriffen werden (z. B. Knoppix ). Es gibt für diesen Zweck neben universellen Programmen wie dd und shred speziell für das Löschen verschiedene Open-Source -Programme, beispielsweise Darik's Boot and Nuke (DBAN). In Apples Mac OS X sind entsprechende Funktionen („Papierkorb sicher löschen“ und „Volume mit Nullen überschreiben“) bereits enthalten. Es kann auch der komplette freie Speicher der Festplatte überschrieben werden, um so zu verhindern, dass gelöschte, aber nicht überschriebene Daten (oder Fragmente oder Kopien davon) wiederhergestellt werden können. Um zu verhindern, dass sich Daten mit Spezialhardware z. B. von Datenwiederherstellungsunternehmen oder Behörden wiederherstellen lassen, wurde 1996 ein Verfahren vorgestellt (die „ Gutmann-Methode “), um ein sicheres Löschen der Daten durch mehrmaliges Überschreiben zu garantieren. Jedoch genügt bei heutigen Festplatten bereits das einmalige Überschreiben. [24]

Alternativ bietet sich bei der Verschrottung des Computers die mechanische Vernichtung der Festplatte beziehungsweise der Scheiben an, eine Methode, die das Bundesamt für Sicherheit in der Informationstechnik empfiehlt. [25] Deshalb werden in manchen Unternehmen beim Umstieg auf eine neue Computergeneration alle Festplatten in einem Schredder in kleine Teile zermahlen und die Daten so vernichtet.

Ist die gesamte Festplatte wirksam verschlüsselt, so ist das wirksame Verwerfen des Zugriffsschlüssels einer Löschung weitgehend gleichzusetzen.

Langzeitarchivierung

Geschichte

Vorläufer der Festplatte war die Magnettrommel ab 1932. Außerhalb von Universitäten und Forschungseinrichtungen kam dieser Speicher ab 1958 als „Hauptspeicher“ mit 8192 Worten à 32 Bit in der Zuse Z22 zum Einsatz. Erfahrungen bzgl. magnetischer Beschichtungen lieferten Bandgeräte . Die erste kommerziell erhältliche Festplatte, die IBM 350 , wurde von IBM 1956 als Teil des IBM 305 RAMAC -Rechners („Random Access Method of Accounting and Control“) angekündigt.

Chronologische Übersicht

- September 1956: [26] IBM stellt das erste magnetische Festplattenlaufwerk mit der Bezeichnung „ IBM 350 “ vor (5 MB (1 Byte umfasst hier 6 bit, das Laufwerk mithin insgesamt 30 MBit), 24 Zoll, 600 ms Zugriffszeit, 1200 min −1 , 500 kg, 10 kW ). Die Schreib-Lese-Köpfe wurden elektronisch-pneumatisch gesteuert, weshalb die schrankgroße Einheit einen Druckluft-Kompressor enthielt. [27] Das Laufwerk wurde nicht verkauft, sondern für 650 US-Dollar pro Monat vermietet. [28] Ein Exemplar der IBM350 befindet sich im Museum des IBM-Clubs in Sindelfingen . An der Entwicklung wesentlich beteiligt am Forschungszentrum in San José (Leitung Reynold B. Johnson ) waren Louis Stevens , William A. Goddard , John Lynott .

- 1973: IBM startet das „Winchester“-Projekt, das sich damit befasste, einen rotierenden Speicher mit einem fest montierten Medium zu entwickeln ( IBM 3340 , 30 MB Speicherkapazität, 30 ms Zugriffszeit). Beim Starten und Stoppen des Mediums sollten die Köpfe auf dem Medium aufliegen, was einen Lademechanismus überflüssig machte. Namensgeber war das Winchester-Gewehr . [29] Diese Technik setzte sich in den folgenden Jahren durch. Bis in die 1990er-Jahre wurde deshalb für Festplatten gelegentlich die Bezeichnung Winchester-Laufwerk verwendet. [30]

- 1979: Vorstellung der ersten 8″-Winchester-Laufwerke. Diese waren jedoch sehr schwer und teuer; trotzdem stieg der Absatz kontinuierlich.

- 1980: Verkauf der ersten 5,25″-Winchester-Laufwerke durch die Firma Seagate Technology („ST506“, 6 MB, 3600 min −1 , Verkaufspreis etwa 1000 US-Dollar). Diese Modellbezeichnung ( ST506 ) wurde über viele Jahre hinaus der Name für diese neue angewendete Schnittstelle, die alle anderen Firmen als neuen Standard im PC-Bereich übernommen hatten. Zur gleichen Zeit kam neben den bereits bestehenden Apple-Microcomputern der erste PC von IBM auf den Markt, dadurch stieg die Nachfrage nach diesen – im Vergleich zu den Winchester-Laufwerken kompakten – Festplatten rasant an.

- 1986: Spezifikation von SCSI , eines der ersten standardisierten Protokolle für eine Festplattenschnittstelle.

- 1989: Standardisierung von IDE , auch bekannt als AT-Bus.

- 1991: erste 2,5-Zoll-Festplatte mit 100 MB Speicherkapazität [31]

- 1997: Erster Einsatz des Riesen-Magnetowiderstands (englisch Giant Magnetoresistive Effect (GMR) ) bei Festplatten, dadurch konnte die Speicherkapazität erheblich gesteigert werden. Eine der ersten Festplatten mit GMR-Leseköpfen brachte IBM im November 1997 heraus ( IBM Deskstar 16GP DTTA-351680 , 3,5″, 16,8 GB, 0,93 kg, 9,5 ms, 5400 min −1 ).

- 2004: Erste SATA-Festplatten mit Native Command Queuing von Seagate .

- 2005: Prototyp einer 2,5-Zoll-Hybrid-Festplatte (Kurzbezeichnung H-HDD ), die aus einem magnetisch-mechanischen Teil und einem zusätzlichen NAND-Flash-Speicher aufgebaut ist, der als Puffer für die Daten dient. Erst wenn der Puffer voll ist, werden die Daten aus dem Puffer auf das Magnetmedium der Festplatte geschrieben.

- 2006: Erste 2,5-Zoll-Notebook-Festplatte ( Momentus 5400.3 , 2,5″, 160 GB, 0,1 kg, 5,6 ms, 5400 min −1 , 2 Watt) von Seagate mit senkrechter Aufzeichnungstechnik (Perpendicular Recording) . 3,5-Zoll-Festplatten erreichen mit derselben Aufzeichnungstechnik im April eine Kapazität von 750 GB.

- 2007: Die erste Terabyte-Festplatte von Hitachi. [32] (3,5″, 1 TB, 0,7 kg, 8,5 ms, 7200 min −1 , 11 Watt)

- 2009: Erste 2-TB-Festplatte von Western Digital ( Caviar Green , 5400 min −1 )

- 2010: Erste 3-TB-Festplatte von Western Digital ( Caviar Green ). Systeme ohneUEFI können diese Festplatte nicht ansprechen. WD liefert eine spezielle Controllerkarte mit, mit welcher die 2,5 TB und 3 TB großen Festplatten von PCs mit älterem Bios als sekundäre Platten voll angesprochen werden können. Seagate umgeht dieses Problem durch den Einsatz größerer Sektoren ( Advanced Format ).

- 2011: Überschwemmungen zerstörten etliche Fabriken in Thailand und machten die weltweiten Abhängigkeiten unter anderem der Festplattenindustrie deutlich: Lieferausfälle führten zur Knappheit von Bauelementen und die Preise für Festplatten auf dem Endverbrauchermarkt in Deutschland schnellten auf ein Mehrfaches in die Höhe. Hitachi GST beziehungsweise Western Digital liefert in kleinen Stückzahlen die ersten 4-TB-3,5″-Festplatten Deskstar 5K4000 (intern) beziehungsweise Touro Desk (externe USB-Variante) mit 1 TB pro Platter aus. [33] Auch Samsung kündigt entsprechende Modelle mit einer Kapazität von 1 TB pro Platter an. Erste Modelle sollen die Spinpoint F6 mit 2 TB und 4 TB sein.

- 2014: Erste 6- und 8-TB-Festplatten mit Heliumfüllung von HGST . [16]

- 2015: Erste 10-TB-Festplatte mit Heliumfüllung und Shingled Magnetic Recording von HGST. [34]

Entwicklung der Speicherkapazitäten der verschiedenen Baugrößen

| Jahr | 5,25″ | 3,5″ | 2,5″ | 1,8″ | 1,0″ | 0,85″ | andere Größe |

typ. Modell(e) mit hoher Kapazität | Quelle |

|---|---|---|---|---|---|---|---|---|---|

| 1956 | 3,75 MB | IBM 350 (1200 min −1 , 61 cm Durchmesser, 1 t Masse) | [35] | ||||||

| 1962–1964 | ≈ 25/28 MB | IBM Ramac 1301 (1800 min −1 ) | [36] | ||||||

| 1980 | 5 MB | Seagate ST-506 , erste 5,25″-Platte | |||||||

| 1981 | 10 MB | Seagate ST-412 (5,25″ FH) (nur im IBM PC XT ) | |||||||

| 1983 | – | 10 MB | Rodime RO352 (3,5″ HH) | [37] | |||||

| 1984 | 20 MB | – | Seagate ST-225 (5,25″ HH) | ||||||

| 1987 | 300 MB | – | Maxtor mit 300 MB (5,25″) für 16.800 DM (PC/AT) bzw. 17.260 DM (PC/XT), Januar 1987 | ||||||

| 1988 | 360 MB | 60 MB | Maxtor XT-4380E (5,25″ FH) bzw. IBM WD-387T (3,5″ HH, z. B. in IBM PS/2-Serie verbaut) | ||||||

| 1990 | 676 MB | 213 MB | Maxtor XT-8760E (5,25″ FH) bzw. Conner CP3200 (3,5″ HH) | ||||||

| 1991 | 1,3 GB | 130 MB | 40 MB | Seagate ST41600N (5,25″ FH), Maxtor 7131 (3,5″), Conner CP2044PK (2,5″) | |||||

| 1992 | 2 GB | 525 MB | 120 MB | – | – | – | 20 MB (1,3″) | Digital DSP-5200S ('RZ73', 5,25″), Quantum Corporation ProDrive LPS 525S (3,5″ LP) bzw. Conner CP2124 (2,5″), Hewlett-Packard HP3013 „Kittyhawk“ (1,3″) | [38] [39] |

| 1993 | – | 1,06 GB | – | – | – | – | Digital RZ26 (3,5″) | ||

| 1994 | – | 2,1 GB | – | – | – | – | Digital RZ28 (3,5″) | ||

| 1995 | 9,1 GB | 2,1 GB | 422 MB | – | – | – | Seagate ST410800N (5,25″ FH), Quantum Corporation Atlas XP32150 (3,5″ LP), Seagate ST12400N bzw. Conner CFL420A (2,5″) | ||

| 1997 | 12 GB | 16,8 GB | 4,8 GB | – | – | – | Quantum Bigfoot (12 GB, 5,25″), Nov. 1997, IBM Deskstar 16GP (3,5″) bzw. Fujitsu MHH2048AT (2,5″) | [40] | |

| 1998 | 47 GB | – | – | – | – | – | Seagate ST446452W (47 GB, 5,25″), 1. Quartal 1998 | [41] | |

| 2001 | † | 180 GB | 40 GB | – | 340 MB | – | Seagate Barracuda 180 (ST1181677LW) | ||

| 2002 | † | 320 GB | 60 GB | – | – | – | Maxtor MaXLine-Plus-II (320 GB, 3,5″), Ende 2002; IBM IC25T060 AT-CS | [42] | |

| 2005 | † | 500 GB | 120 GB | 60 GB | 8 GB | 6 GB | Hitachi Deskstar 7K500 (500 GB, 3,5″), Juli 2005 | [43] | |

| 2006 | † |

750 GB* |

200 GB | 80 GB | 8 GB | † | Western Digital WD7500KS, Seagate Barracuda 7200.10 750 GB, ua | [44] | |

| 2007 | † |

1 TB* |

320 GB* |

160 GB | 8 GB | † | Hitachi Deskstar 7K1000 (1000 GB, 3,5″), Januar 2007 | [45] | |

| 2008 | † |

1,5 TB* |

500 GB* |

250 GB* |

† | † |

Seagate ST31500341AS (1500 GB, 3,5″), Juli 2008 Samsung Spinpoint M6 HM500LI (500 GB, 2,5″), Juni 2008 Toshiba MK2529GSG (250 GB, 1,8″), September 2008 LaCie LF (40 GB, 1,3″), Dezember 2008 |

[46] [47] [48] [49] |

|

| 2009 | † |

2 TB* |

1 TB* |

250 GB* |

† | † | Western Digital Caviar Green WD20EADS (2000 GB, 3,5″), Januar 2009, Seagate Barracuda LP ST32000542AS (2 TB, 3,5″, 5900 min −1 ) Western Digital Scorpio Blue WD10TEVT (1000 GB, 2,5″, Bauhöhe 12,5 mm), Juli 2009 sowie WD Caviar Black WD2001FASS und RE4 (beide 2 TB, September 2009) Hitachi Deskstar 7K2000 (2000 GB, 3,5″), August 2009 |

[50] |

|

| 2010 | † |

3 TB* |

1,5 TB* |

320 GB* |

† | † | Hitachi Deskstar 7K3000 & Western Digital Caviar Green (3,5″) Seagate FreeAgent GoFlex Desk (2,5″), Juni 2010 Toshiba MK3233GSG (1,8″) |

[53] | |

| 2011 | † |

4 TB* |

1,5 TB* |

320 GB* |

† | † | Seagate FreeAgent® GoFlex™ Desk (4 TB, 3,5″), September 2011 | [54] | |

| 2012 | † |

4 TB* |

2 TB* |

320 GB* |

† | † | Western Digital Scorpio Green 2000 GB, SATA II (WD20NPVT), August 2012 | [55] | |

| 2013 | † |

6 TB* |

2 TB* |

320 GB* |

† | † |

HGST Travelstar 5K1500 1.5 TB, SATA 6 Gbit/s, 9,5 mm, 2,5 Zoll (0J28001), August 2013 Samsung Spinpoint M9T, 2 TB, SATA 6 Gbit/s, 9,5 mm, 2,5 Zoll, November 2013 HGST Ultrastar He6, 6 TB, 3.5″, sieben Platter mit Heliumfüllung, November 2013 |

[56] [57] [16] |

|

| 2014 | † |

8 TB* |

2 TB* |

320 GB* |

† | † |

HGST Ultrastar He8, 8 TB, 3,5″, sieben Platter mit Heliumfüllung, Oktober 2014 Seagate Archive HDD v2, 8 TB, 3,5″, sechs Platter mit Luftfüllung, Verwendung von Shingled Magnetic Recording , Dezember 2014 |

[58] [59] |

|

| 2015 | † |

10 TB** |

4 TB* |

† | † | † | HGST Ultrastar Archive Ha10, 10 TB, 3,5″, sieben Platter mit Heliumfüllung, Juni 2015 Toshiba Stor.E Canvio Basics, 3 TB, 15mm, 2,5″, vier Platter, April 2015 Samsung Spinpoint M10P, 4 TB, 15 mm, 2,5″, fünf Platter, Juni 2015 |

[60] [61] [62] |

|

| 2016 | † |

12 TB* |

5 TB** |

† | † | † | Seagate Barracuda Compute, 5 TB, 15 mm, 2,5″, fünf Platter, Oktober 2016 HGST Ultrastar He10 12 TB, 3,5″, acht Platter mit Heliumfüllung, Dezember 2016 |

[63] [64] |

|

| 2017 | † | 14 TB* | 5 TB** | † | † | † | Toshiba Enterprise MG06ACA, 10 TB, 3,5″, sieben Platter mit Luftfüllung, September 2017 Toshiba Enterprise MG07ACA, 14 TB, 3,5″, neun Platter mit Heliumfüllung, Dezember 2017 |

[65] [66] |

|

| 2019 | † | 16 TB* | 5 TB** | † | † | † | Seagate Exos X16, 16 TB, 3,5″, 9 Platter mit TDMR und Heliumfüllung, Juni 2019 |

[67] |

|

| 2020 | † | 18 TB* | 5 TB** | † | † | † | Western Digital Ultrastar DC HC550, 18 TB, 3.5″, 9 Platter mit TDMR, EAMR und Heliumfüllung, Juli 2020 |

[68] |

Anmerkungen:

- Die Kapazitätsangaben beziehen sich immer auf das im jeweiligen Jahr größte käuflich erhältliche Festplattenlaufwerk, unabhängig von seiner Drehzahl oder Schnittstelle.

- Die Hersteller von Festplatten verwenden bei Speicherkapazitäten SI-Präfixe (1000 B = 1 kB usw.). Das entspricht der Empfehlung der International Electrotechnical Commission (IEC), steht aber im Gegensatz zu mancher Software, wodurch es u. U. zu scheinbaren Größenunterschieden kommt. Für Details siehe Abschnitt Speicherkapazität .

- †: Baugröße veraltet; nicht mehr in Gebrauch

- *: unter Verwendung von Perpendicular Recording

- **: unter Verwendung von Shingled Magnetic Recording

Hersteller

Im zweiten Quartal 2013 wurden weltweit 133 Millionen Festplattenlaufwerke mit einer Gesamtkapazität von 108 Exabyte (108 Millionen Terabyte) abgesetzt. [69] Im Jahr 2014 wurden weltweit 564 Millionen Festplattenlaufwerke mit einer Gesamtkapazität von 529 Exabyte produziert. [70] [71] 87,7 Millionen Festplattenlaufwerke wurden weltweit im vierten Quartal 2018 abgesetzt. [72]

| Name | |

|---|---|

| Seagate | 40 % |

| Western Digital | 37 % |

| Toshiba /Kioxia | 23 % |

Ehemalige Hersteller:

- Conner Peripherals wurde 1996 von Seagate übernommen.

- Quantum wurde 2000 von Maxtor und Maxtor 2005 von Seagate übernommen.

- IBMs Festplattensparte wurde 2002 von Hitachi übernommen.

- Fujitsus Festplattensparte wurde 2010 von Toshiba übernommen. [73]

- ExcelStor produzierte für IBM bzw. später für HGST/Hitachi einige Modelle.

- Samsungs Festplatten-Sparte wurde im Oktober 2011 von Seagate übernommen. [74]

- HGST (Hitachi) wurde im März 2012 von Western Digital übernommen, [75] wobei WD auf Druck der Kartellbehörden einen Teil der 3,5″-Produktionseinrichtungen an Toshiba abgeben musste. [76]

- Siehe auch Kategorie:Ehemaliger Festplatten-Hersteller

Weblinks